班牛数据集成到班牛:查询班牛收货仓库

在当前复杂多变的业务环境中,数据的高效、准确及实时处理成为企业运作的重要基础。此次技术案例,我们将详细分享如何通过轻易云数据集成平台,实现班牛系统中的"收货仓库"信息查询与对接。

本次方案所关注的具体任务是利用轻易云平台,从起始API column.list 获取原始数据信息,并经过一系列的数据转换和清洗步骤,最终调用 workflow.task.create 接口,将优化后的数据高效写入目标班牛系统。从选择合适的数据接口,到应对限流问题,再到确保批量操作不遗漏任何单据,每一步骤都至关重要且充满挑战。

我们采用了如下关键技术手段来确保整个对接流程顺利进行:

-

支持高吞吐量的数据写入能力:通过优化并行处理机制,使得大量来自

column.list接口的数据能够快速无误地被写入到目标班牛系统。 -

提供了完善的集中监控和告警系统:实时跟踪每个集成任务状态与性能指标,一旦发现异常情况立即触发告警,为后续调整提供依据。

-

实现了灵活强大的自定义数据转换逻辑:根据业务需求,对获取的原始数据信息进行了格式化、过滤和映射等操作,以满足特定应用场景下的数据结构要求。

-

采用先进的异常处理与错误重试机制:针对可能出现的网络波动或第三方限制,通过自动重试及绕过策略,提高整体过程稳定性和可靠性。

-

确保全程透明度,通过可视化工具设计并管理数据流,使得工程师能直观理解各阶段任务执行情况,有助于快速定位问题并加以解决。

这些技术要点不仅使得此次“查询班牛收货仓库”的对接工作更加精确,而且极大提升了业务运行效率。以下章节将详尽描述从初始化配置到最终实现的一步步细节,以及过程中遇到的问题与解决方案。

调用班牛接口column.list获取并加工数据

在数据集成的生命周期中,调用源系统接口获取数据是至关重要的一步。本文将深入探讨如何通过轻易云数据集成平台调用班牛的column.list接口,并对获取的数据进行初步加工。

接口调用配置

根据提供的元数据配置,我们需要调用班牛的column.list接口。以下是具体的配置细节:

- API:

column.list - 请求方法:

GET - 主要字段:

project_id: 固定值为25821column_id: 用于条件过滤,值为59785

元数据配置中的关键部分如下:

{

"api": "column.list",

"effect": "QUERY",

"method": "GET",

"number": "column_id",

"id": "column_id",

"idCheck": true,

"request": [

{

"field": "project_id",

"label": "project_id",

"type": "string",

"value": "25821"

}

],

"buildModel": true,

"autoFillResponse": true,

"condition": [

[

{

"field": "column_id",

"logic": "eqv2",

"value": "59785"

}

]

],

"beatFlat": ["options"]

}数据请求与清洗

在实际操作中,首先需要通过HTTP GET请求从班牛系统获取原始数据。请求URL格式如下:

https://api.banniu.com/column.list?project_id=25821&column_id=59785该请求会返回一个JSON格式的数据,其中包含了多个字段。为了确保数据的准确性和完整性,我们需要对返回的数据进行初步清洗和验证。

- 字段验证: 确保返回的数据包含所需的字段,如

column_id。 - 数据类型检查: 验证每个字段的数据类型是否符合预期,例如

project_id应为字符串类型。 - 去重处理: 如果返回的数据中存在重复记录,需要进行去重处理。

数据转换与写入

在完成初步清洗后,需要对数据进行转换,以便写入目标系统。转换过程包括以下几个步骤:

- 字段映射: 将源系统中的字段映射到目标系统中的相应字段。例如,将班牛的

column_id映射到目标系统中的相应字段。 - 格式转换: 根据目标系统的要求,对数据格式进行转换。例如,将日期格式从YYYY-MM-DD转换为MM/DD/YYYY。

- 数据填充: 根据业务需求,自动填充一些必要的字段。例如,可以根据规则自动生成某些缺失值。

实际案例

假设我们从班牛接口获取到以下原始数据:

{

"columns": [

{

"column_id": 59785,

"name": "Warehouse A",

...

},

...

]

}经过清洗和转换后,我们可能得到如下结构的数据:

{

"warehouses": [

{

"id": 59785,

"name": "Warehouse A",

...

},

...

]

}这些处理后的数据可以直接写入目标系统,确保无缝对接和高效集成。

小结

通过轻易云数据集成平台调用班牛的column.list接口,并对获取的数据进行清洗和转换,是实现不同系统间无缝对接的重要步骤。本文详细介绍了如何配置接口调用、清洗和转换数据,为实现高效的数据集成提供了技术参考。

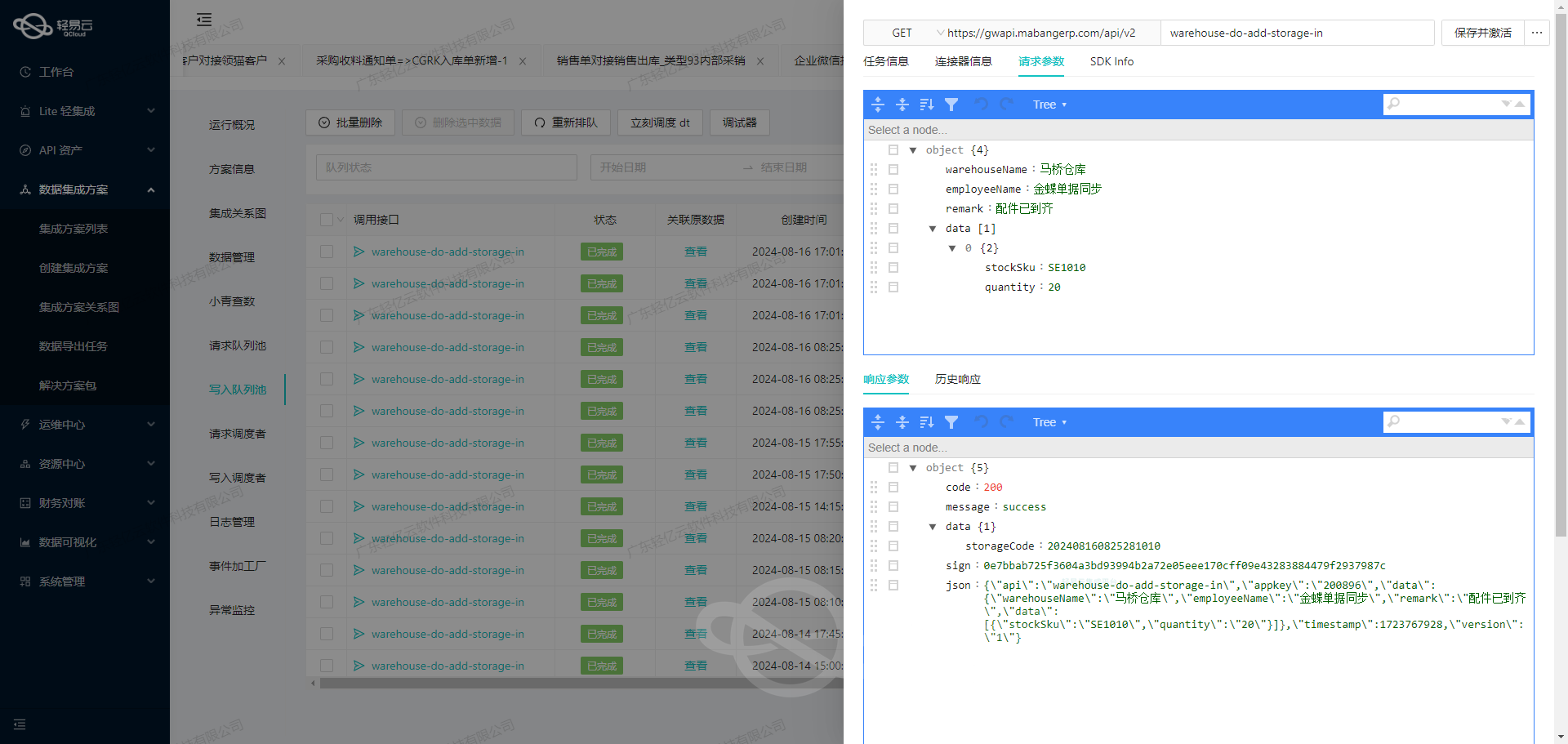

使用轻易云数据集成平台进行ETL转换并写入班牛API接口

在数据集成生命周期的第二步,我们需要将已经集成的源平台数据进行ETL转换,转为目标平台班牛API接口所能够接收的格式,最终写入目标平台。本文将深入探讨如何使用轻易云数据集成平台完成这一过程,并提供详细的技术案例。

数据请求与清洗

在进行ETL转换之前,首先需要从源平台获取原始数据并进行清洗。这一步通常包括去除重复数据、处理缺失值以及标准化数据格式等操作。假设我们已经完成了这一步,接下来将重点放在数据转换与写入阶段。

数据转换与写入

根据提供的元数据配置,我们需要将清洗后的数据通过班牛API接口写入目标平台。以下是具体步骤和技术细节:

1. 配置API接口

根据元数据配置,我们使用的是班牛API中的workflow.task.create接口,该接口用于创建任务。配置如下:

{

"api": "workflow.task.create",

"effect": "EXECUTE",

"method": "POST",

"idCheck": true

}2. 数据转换

在调用API之前,需要确保我们的数据符合班牛API所需的格式。假设源平台的数据结构如下:

{

"order_id": "12345",

"product_name": "Widget",

"quantity": 10,

"warehouse_id": "WH001"

}而班牛API要求的数据结构可能是:

{

"taskId": "12345",

"taskName": "Widget Order",

"taskQuantity": 10,

"warehouseCode": "WH001"

}因此,我们需要进行字段映射和重命名。例如:

def transform_data(source_data):

return {

"taskId": source_data["order_id"],

"taskName": source_data["product_name"] + " Order",

"taskQuantity": source_data["quantity"],

"warehouseCode": source_data["warehouse_id"]

}3. 调用API接口

使用轻易云数据集成平台的可视化操作界面,我们可以配置HTTP请求来调用班牛API。以下是一个示例请求配置:

- URL:

https://api.banniu.com/workflow/task/create - Method:

POST - Headers:

Content-Type:application/jsonAuthorization:Bearer <your_access_token>

- Body:

{ "taskId": "{{transformed_data.taskId}}", "taskName": "{{transformed_data.taskName}}", "taskQuantity": "{{transformed_data.taskQuantity}}", "warehouseCode": "{{transformed_data.warehouseCode}}" }

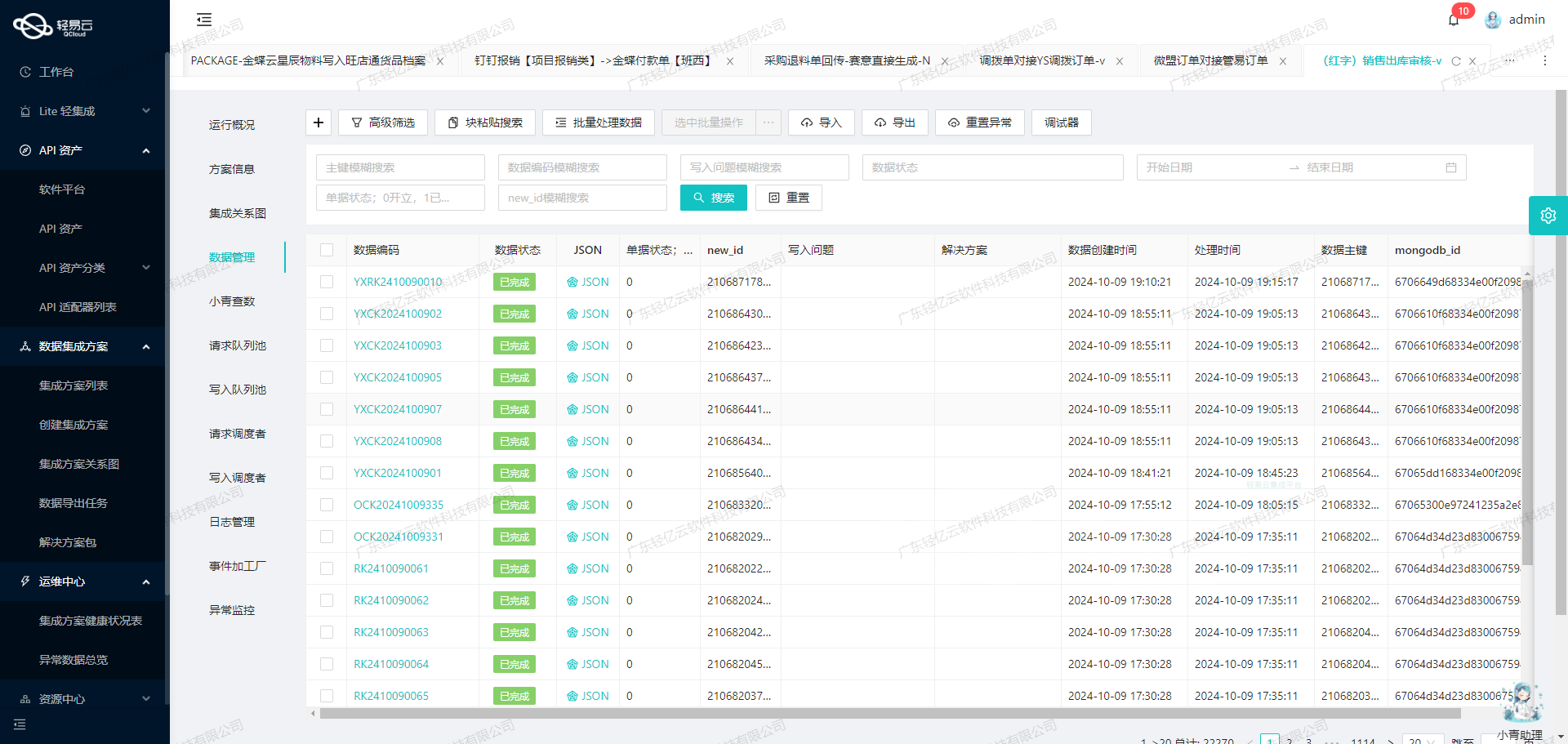

4. 实时监控与日志记录

为了确保数据成功写入目标平台,轻易云提供了实时监控和日志记录功能。通过这些功能,可以实时查看每个请求的状态和响应,及时发现并解决问题。

示例代码整合

以下是一个完整的Python示例代码,用于展示如何从源平台获取数据、进行转换并调用班牛API接口:

import requests

# 假设我们已经从源平台获取了原始数据

source_data = {

"order_id": "12345",

"product_name": "Widget",

"quantity": 10,

"warehouse_id": "WH001"

}

# 数据转换函数

def transform_data(source_data):

return {

"taskId": source_data["order_id"],

"taskName": source_data["product_name"] + " Order",

"taskQuantity": source_data["quantity"],

"warehouseCode": source_data["warehouse_id"]

}

# 转换后的数据

transformed_data = transform_data(source_data)

# 调用班牛API接口

url = 'https://api.banniu.com/workflow/task/create'

headers = {

'Content-Type': 'application/json',

'Authorization': 'Bearer <your_access_token>'

}

response = requests.post(url, json=transformed_data, headers=headers)

# 检查响应状态

if response.status_code == 200:

print("Data successfully written to BanNiu API")

else:

print(f"Failed to write data: {response.status_code}, {response.text}")通过以上步骤和示例代码,可以高效地完成从源平台到班牛目标平台的数据ETL转换与写入过程。在实际应用中,还需根据具体业务需求对代码和配置进行适当调整。