聚水潭数据集成到MySQL的技术探讨

在本次案例中,我们聚焦于如何将聚水潭系统中的其他出入库单数据,无缝对接并批量写入到MySQL数据库。这个过程涉及多个关键环节和技术挑战,包括API接口调用、数据格式转换及分页处理等。

首先,获取聚水潭的数据需要调用其提供的API接口 /open/other/inout/query。为了实现定时可靠的数据抓取,可以设置定时任务,通过HTTP请求按需获取最新的出入库单信息,并进行初步的数据校验和预处理。

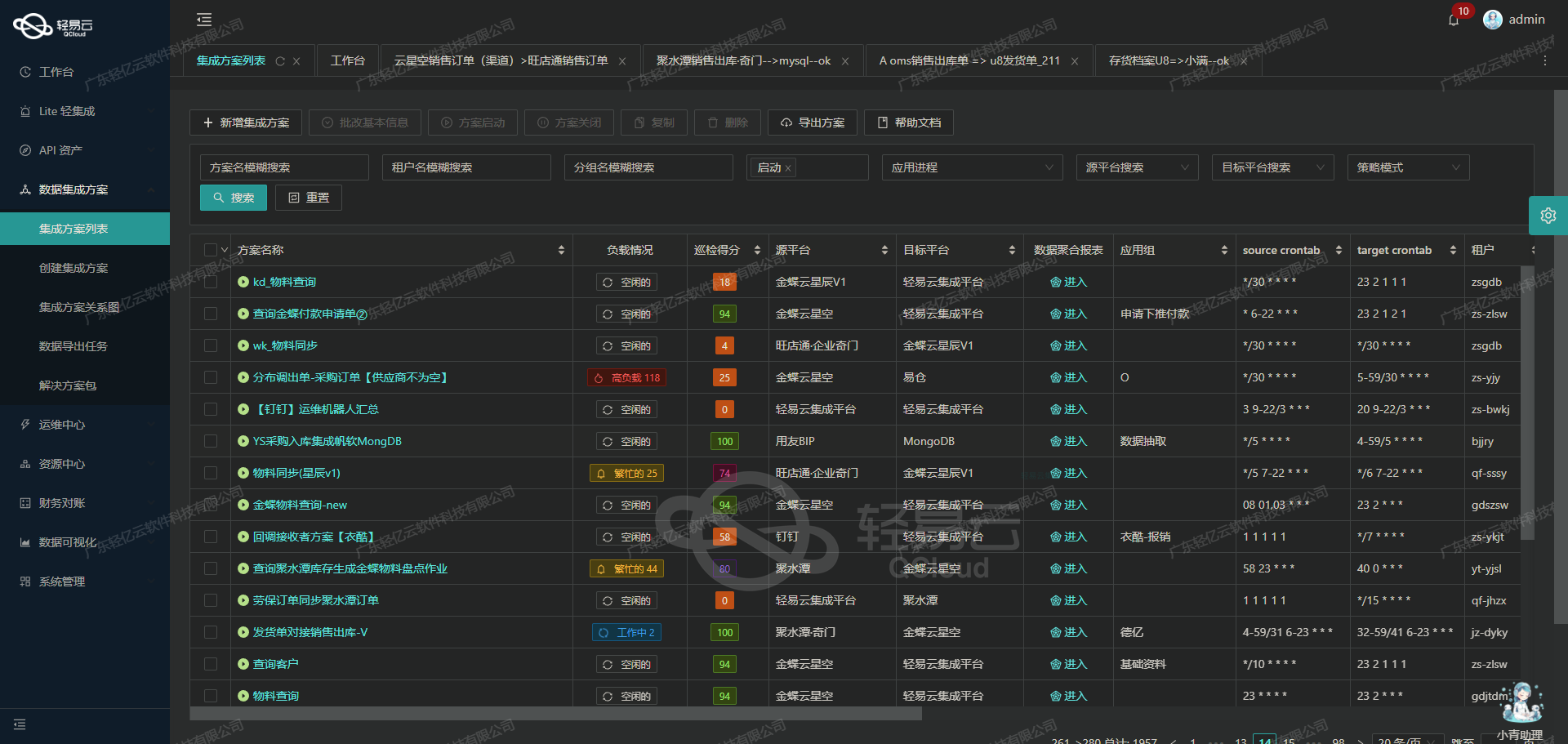

在实际操作中,确保高吞吐量的数据写入能力是至关重要的一环。在将大量数据快速导入MySQL前,需要考虑使用分批次、多线程或异步处理机制,以最大化传输效能。同时,利用轻易云平台提供的可视化设计工具,可以直观地设计整个数据流,从而提升管理效率和透明度。

针对可能出现的数据质量问题,系统还具备实时监控与告警功能。一旦检测到异常,例如网络波动导致部分请求失败,可以即时采取重试机制进行错误修复。而在日常运行过程中,通过统一视图对API资产进行全面掌握,有助于企业优化资源配置,实现更高效的运营。

此外,为适应业务需求,在构建对接方案时还必须自定义数据转换逻辑。这不仅包括简单字段映射,还涉及复杂结构调整,使得两端系统能够顺畅协作。例如,在解决分页限流问题上,可通过合理控制每页大小及逐页请求策略来维持稳定性。

随着集合体量不断增大,对应日志记录与实时监控也变得尤为重要。通过细致跟踪每一步状态变化,不仅保障了整体流程平稳运行,也为后续排障提供了宝贵依据。这些措施共同作用下,我们最终成功实现了从聚水潭到MySQL无缝、高效、安全的数据集成。

调用聚水潭接口获取并加工数据的技术案例

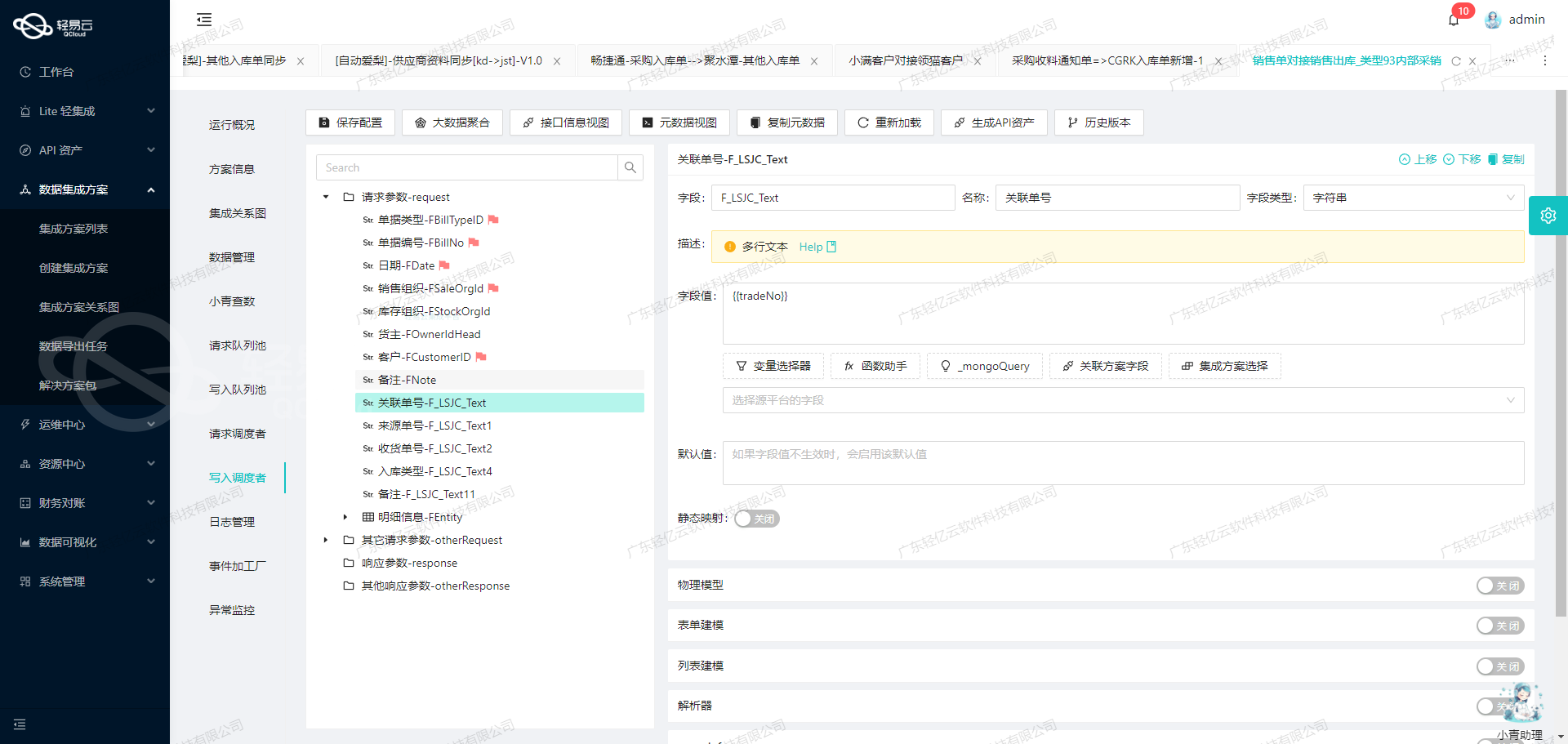

在数据集成生命周期的第一步,我们需要调用源系统的API接口来获取原始数据,并进行初步加工。本文将详细探讨如何通过轻易云数据集成平台调用聚水潭接口/open/other/inout/query,并对返回的数据进行处理。

接口调用配置

首先,我们需要配置元数据,以便正确调用聚水潭的API接口。以下是元数据配置的详细说明:

{

"api": "/open/other/inout/query",

"effect": "QUERY",

"method": "POST",

"number": "io_id",

"id": "io_id",

"request": [

{"field": "modified_begin", "label": "修改起始时间", "type": "datetime", "value": "{{LAST_SYNC_TIME|datetime}}"},

{"field": "modified_end", "label": "修改结束时间", "type": "datetime", "value": "{{CURRENT_TIME|datetime}}"},

{"field": "status", "label": "单据状态", "type": "string", "value": "Confirmed"},

{"field": "date_type", "label": "时间类型", "type": "string", "value": "2"},

{"field": "page_index", "label": "第几页", "type": "string", "value": "1"},

{"field": "page_size", "label": "每页多少条",

### 轻易云数据集成平台ETL转换与写入MySQLAPI接口技术案例

在数据集成生命周期的第二步,我们将重点探讨如何将已经集成的源平台数据进行ETL转换,并转为目标平台 MySQL API 接口所能够接收的格式,最终写入目标平台。以下是具体的技术实现过程。

#### 数据请求与清洗

首先,我们从源平台获取原始数据。这些数据需要经过清洗,以确保其符合目标系统的要求。清洗过程包括去除冗余字段、规范化字段名称和格式等。以下是一个示例元数据配置,用于定义从源平台提取的数据字段及其对应关系:

```json

{

"api": "batchexecute",

"effect": "EXECUTE",

"method": "SQL",

"number": "id",

"id": "id",

"name": "id",

"idCheck": true,

"request": [

{"field":"id","label":"主键","type":"string","value":"{io_id}-{items_ioi_id}"},

{"field":"io_id","label":"出仓单号","type":"string","value":"{io_id}"},

{"field":"io_date","label":"单据日期","type":"string","value":"{io_date}"},

{"field":"status","label":"单据状态","type":"string","value":"{status}"},

{"field":"so_id","label":"线上单号","type":"string","value":"{so_id}"},

{"field":"type","label":"单据类型","type":"string","value":"{type}"},

{"field":"f_status","label":"财务状态","type":"string","value":"{f_status}"},

{"field":"warehouse","label":"仓库名称","type":"string","value":"{warehouse}"},

{"field":"receiver_name","label":"收货人","type":"string","value":"{receiver_name}"},

{"field":"receiver_mobile","label":"收货人手机","type":"string","value":"{receiver_mobile}"},

{"field":"receiver_state","label":"收货人省","type":"string","value":"{receiver_state}"},

{"field":"receiver_city","label":"收货人市","type":"","value":""},

...

],

"otherRequest":[

{

"field": "main_sql",

"label": "主语句",

"type": "string",

"describe": "SQL首次执行的语句,将会返回:lastInsertId",

"value":

`REPLACE INTO other_inout_query

(id, io_id, io_date, status, so_id, type, f_status, warehouse, receiver_name, receiver_mobile, receiver_state, receiver_city, receiver_district, receiver_address, wh_id, remark, modified, created, labels, wms_co_id, creator_name, wave_id, drop_co_name,inout_user,l_id,lc_id,logistics_company,

lock_wh_id,lock_wh_name,

items_ioi_id,

items_sku_id,

items_name,

items_unit,

items_properties_value,

items_qty,

items_cost_price,

items_cost_amount,

items_i_id,

items_remark,

items_io_id,

items_sale_price,

items_sale_amount,

items_batch_id,

items_product_date,

items_supplier_id,

items_expiration_date,sns_sku_id,sns_sn) VALUES`

},

{

"field": "limit",

"label": "limit",

"type": "string",

"value": "1000"

}

]

}数据转换

在数据清洗之后,下一步是将这些数据进行转换,以符合目标平台 MySQL API 接口所需的格式。在这个过程中,我们使用 SQL 语句来进行批量插入操作。元数据配置中的 main_sql 字段定义了 SQL 插入语句模板。

例如,以下是一个 SQL 插入语句模板:

REPLACE INTO other_inout_query

(id, io_id, io_date, status, so_id, type,f_status ,warehouse ,receiver_name ,receiver_mobile ,receiver_state ,receiver_city ,receiver_district ,receiver_address ,wh_id ,remark ,modified ,created ,labels,wms_co_id ,creator_name,wave_id ,drop_co_name,inout_user,l_id ,lc_id ,logistics_company ,

lock_wh_id ,lock_wh_name ,

items_ioi_id ,

items_sku_id ,

items_name ,

items_unit ,

items_properties_value ,

items_qty ,

items_cost_price ,

items_cost_amount ,

items_i_id ,

items_remark ,

items_io_id ,

items_sale_price ,

items_sale_amount ,

items_batch_id ,

items_product_date ,

items_supplier_id ,

items_expiration_date,sns_sku_id,sns_sn) VALUES数据写入

最后一步是将转换后的数据写入到目标平台的 MySQL 数据库中。我们使用轻易云提供的 batchexecute API 来执行批量插入操作。该 API 支持高效的数据传输和处理,确保大规模数据集成任务能够顺利完成。

在执行批量插入操作时,我们需要注意以下几点:

- 事务管理:确保每次批量操作都是一个事务,以保证数据的一致性。

- 错误处理:捕获并处理可能出现的任何错误,记录日志以便后续排查。

- 性能优化:根据实际需求调整批量操作的大小(如

limit参数),以平衡性能和资源消耗。

通过上述步骤,我们可以高效地完成从源平台到目标平台 MySQL 的数据集成任务,实现不同系统间的数据无缝对接。这不仅提升了业务透明度和效率,也为后续的数据分析和决策提供了坚实的数据基础。