聚水潭-销售订单-->BI彩度-销售订单表(24年1月-5月)

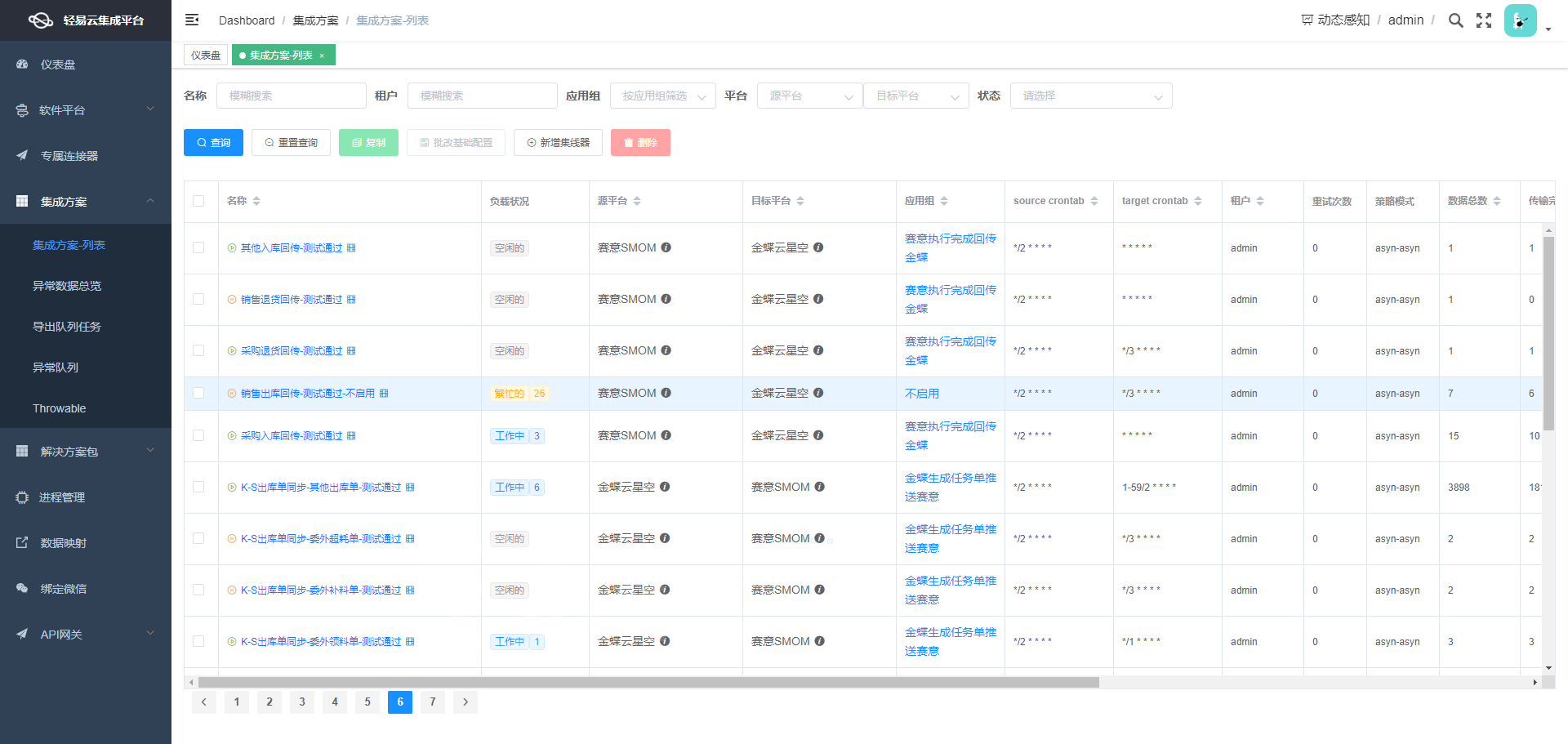

在现代企业的数据管理中,确保各系统之间的无缝集成是业务运营的关键。面对海量数据,我们需要高效、精准且实时的数据处理方案。本案例将详细解析聚水潭·奇门数据集成到MySQL数据库的技术方案,如何通过定制化的数据转换逻辑和高吞吐量的数据写入能力,实现从2024年1月至5月期间的销售订单数据集成。

首先,我们采用轻易云平台提供的可视化设计工具,通过调用聚水潭·奇门API(jushuitan.order.list.query),实现对源数据——销售订单信息的抓取。在这一过程中,为应对大量请求导致的限流及分页问题,我们设置了合理的接口调用频率与分页策略,确保了完整且高效地获取全部订单数据。同时,为保证数据质量和一致性,不遗漏任何一条重要记录,还利用了平台自带的数据质量监控和异常检测功能,及时发现并处理潜在的问题。

而后,将抓取到的信息进行必要的数据转换,以适配MySQL目标数据库结构。为了满足特定业务需求,对部分字段进行了自定义映射。这一步骤显得尤为关键,因为它不仅影响到最终存储结果,还直接关系到后续分析工作的准确性。在完成转换之后,通过MySQL批量写入API(batchexecute),大规模且快速地将处理后的销售订单插入至目标表中。

整个流程具备集中监控与告警系统支持,可以实时跟踪大规模数据传输任务,从状态检查到性能评估均有明确反馈,使异常情况能够被迅速定位并解决。此外,通过实施完善的日志记录机制,每一步操作都变得透明而可追溯,提高了整体运维效率。

总之,这次成功实施聚水潭·奇门与MySQL之间的大规模数据集成,不仅提升了公司内部多个部门间的信息联动,加快决策速度,也为下阶段更复杂、更大体量的数据应用奠定了坚实基础。

调用聚水潭·奇门接口获取并加工数据

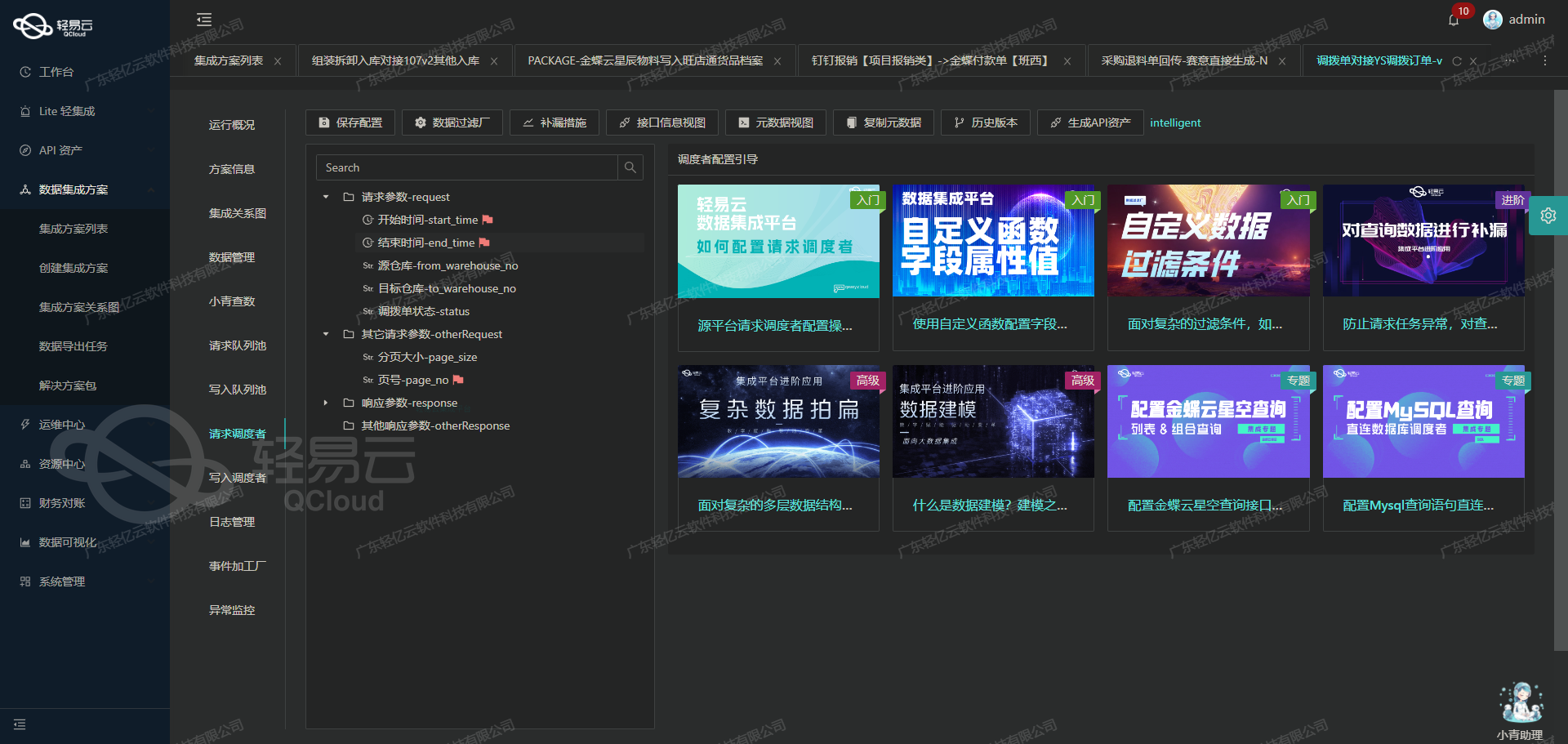

在数据集成的生命周期中,调用源系统接口是至关重要的一步。本文将详细探讨如何通过轻易云数据集成平台调用聚水潭·奇门接口jushuitan.order.list.query,并对获取的数据进行初步加工。

接口调用配置

首先,我们需要配置接口的元数据,以便正确地请求数据。根据提供的元数据配置,我们可以看到以下关键字段:

- api:

jushuitan.order.list.query - method:

POST - number:

io_id - id:

io_id

请求参数包括:

- page_index: 页数,从第一页开始,默认1

- page_size: 每页行数,默认25,最大25

- start_time: 修改开始时间

- end_time: 修改结束时间

- status: 单据状态(WaitConfirm=待出库; Confirmed=已出库; Cancelled=作废)

- date_type: 时间类型(默认0;0=修改时间;1=制单日期;2=出库时间)

这些参数确保了我们能够灵活地分页获取订单数据,并根据时间范围和状态进行筛选。

请求参数设置

为了实现自动化的数据请求,我们需要动态设置start_time和end_time。通常,这些时间参数会基于上次同步时间和当前时间来设定:

{

"page_index": "1",

"page_size": "100",

"start_time": "{{LAST_SYNC_TIME|datetime}}",

"end_time": "{{CURRENT_TIME|datetime}}",

"status": "Confirmed",

"date_type": 0

}这里使用了模板变量{{LAST_SYNC_TIME|datetime}}和{{CURRENT_TIME|datetime}}来动态填充时间范围。这种方式确保了每次请求的数据都是最新的,并且避免了重复处理。

数据清洗与转换

获取到原始数据后,需要对其进行清洗和转换,以便后续处理。轻易云平台提供了自动填充响应和扁平化处理功能,这对于简化数据结构非常有用。例如:

{

"autoFillResponse": true,

"beatFlat": ["items"]

}上述配置表示将响应中的嵌套数组items进行扁平化处理,使得每条记录都能独立存储和处理。这一步骤极大地简化了后续的数据转换工作。

数据写入目标系统

在完成数据清洗与转换后,下一步是将处理后的数据写入目标系统。在本案例中,目标系统是BI彩度的销售订单表。通过轻易云平台,可以方便地将清洗后的数据映射到目标表结构中,实现无缝对接。

例如,将清洗后的订单数据映射到BI彩度的销售订单表时,可以使用如下配置:

{

"target_table": "bi_sales_order",

"mapping": {

"order_id": "io_id",

"order_status": "status",

// 更多字段映射...

}

}这种映射方式确保了源系统与目标系统之间的数据一致性,并且通过轻易云平台的可视化操作界面,可以实时监控整个过程,提高透明度和效率。

总结

通过以上步骤,我们成功实现了从聚水潭·奇门接口获取销售订单数据,并对其进行清洗、转换和写入目标系统的全过程。这不仅展示了轻易云平台在异构系统集成中的强大能力,也为实际业务应用提供了可靠的技术支持。

数据转换与写入:将源平台数据转为MySQL API接口格式

在数据集成生命周期的第二步中,我们需要将已经集成的源平台数据进行ETL转换,转为目标平台 MySQL API接口所能够接收的格式,并最终写入目标平台。本文将详细探讨如何利用轻易云数据集成平台进行这一过程,特别是通过API接口实现数据写入。

元数据配置解析

元数据配置是ETL过程中的核心部分,它定义了如何将源数据字段映射到目标数据库中的字段。以下是一个典型的元数据配置示例:

{

"api": "batchexecute",

"effect": "EXECUTE",

"method": "POST",

"idCheck": true,

"request": [

{"field":"id","label":"主键","type":"string","value":"{o_id}-{items_oi_id}"},

{"field":"order_date","label":"下单时间","type":"string","value":"{order_date}"},

{"field":"shop_status","label":"线上订单状态","type":"string","value":"{shop_status}"},

...

],

"otherRequest": [

{

"field": "main_sql",

"label": "主语句",

"type": "string",

"describe": "SQL首次执行的语句,将会返回:lastInsertId",

"value": "REPLACE INTO order_list_query_24_01_05(id,order_date,shop_status,...) VALUES"

},

{"field":"limit","label":"limit","type":"string","value":"1000"}

]

}数据字段映射

在元数据配置中,每个request对象都定义了一个字段的映射关系,包括字段名称、标签、类型和值。例如:

{"field":"id", "label":"主键", "type":"string", "value":"{o_id}-{items_oi_id}"}

这个配置表示目标数据库中的id字段将由源数据中的o_id和items_oi_id拼接而成。

SQL语句构建

在otherRequest部分,我们定义了一个主要的SQL语句,用于插入或更新记录:

{

"field": "main_sql",

"label": "主语句",

"type": "string",

"describe": "SQL首次执行的语句,将会返回:lastInsertId",

"value":

`REPLACE INTO order_list_query_24_01_05(

id, order_date, shop_status, question_type, shop_id, question_desc, so_id, status,

receiver_state, receiver_city, receiver_district, send_date, plan_delivery_date,

creator_name, buyer_tax_no, invoice_type, pay_amount, freight, buyer_message,

remark, invoice_title, is_cod, type, paid_amount, pay_date, modified,

order_from,l_id ,shop_name,wms_co_id ,logistics_company ,free_amount ,

co_id ,drp_co_id_to ,end_time ,referrer_id ,invoice_data ,drp_info ,

shop_buyer_id ,seller_flag ,invoice_amount ,oaid ,open_id ,node ,

referrer_name ,shop_site ,drp_co_id_from ,un_lid ,receiver_zip ,

receiver_email,f_freight ,created ,receiver_country ,skus ,

shipment ,weight ,sign_time,f_weight,is_split,is_merge,o_id ,

items_batch_id ,items_produced_date ,items_referrer_id ,

items_item_ext_data ,items_src_combine_sku_id ,

items_sku_type ,items_item_pay_amount ,

items_remark ,items_price ,

items_outer_oi_id ,

items_is_gift ,

items_refund_status ,

items_refund_id ,

items_item_status ,

items_i_id ,

items_shop_i_id ,

items_raw_so_id ,

items_is_presale ,

items_oi_id ,

items_properties_value,

items_amount,

items_base_price,

items_qty,

items_name,

items_sku_id,

items_shop_sku_id,

items_buyer_paid_amount,

items_seller_income_amount,

labels,currency,

lc_id,

ts,

merge_so_id,

link_o_id,seller_income_amount,buyer_paid_amount

) VALUES`

}这个SQL语句使用了MySQL的REPLACE INTO语法,可以有效地避免重复记录的问题。每次执行时,这条语句会插入新的记录或更新已有记录。

API请求构建

通过API请求,我们可以将构建好的SQL语句发送到目标MySQL数据库。以下是一个典型的API请求示例:

{

"api": "/batchexecute",

"method": "POST",

...

}在实际操作中,我们需要确保API请求中的所有字段都正确映射,并且数据格式符合目标数据库的要求。

数据处理细节

- 主键生成:通过拼接源数据中的多个字段生成唯一主键,例如

{o_id}-{items_oi_id}。 - 日期格式转换:确保日期字段如

order_date,send_date,pay_date等符合目标数据库的日期格式。 - 金额计算:对于涉及金额计算的字段,如

pay_amount,freight,paid_amount, 我们需要确保其精度和格式符合要求。 - 字符串截取:对于长度有限制的字段,如

items_item_ext_data,我们可以使用_function LEFT( '{items_item_ext_data}' , 20)截取前20个字符。

通过上述步骤,我们可以有效地将源平台的数据转换为目标MySQL API接口所能接受的格式,并最终写入目标平台。这一过程不仅提高了数据处理效率,还确保了数据的一致性和完整性。