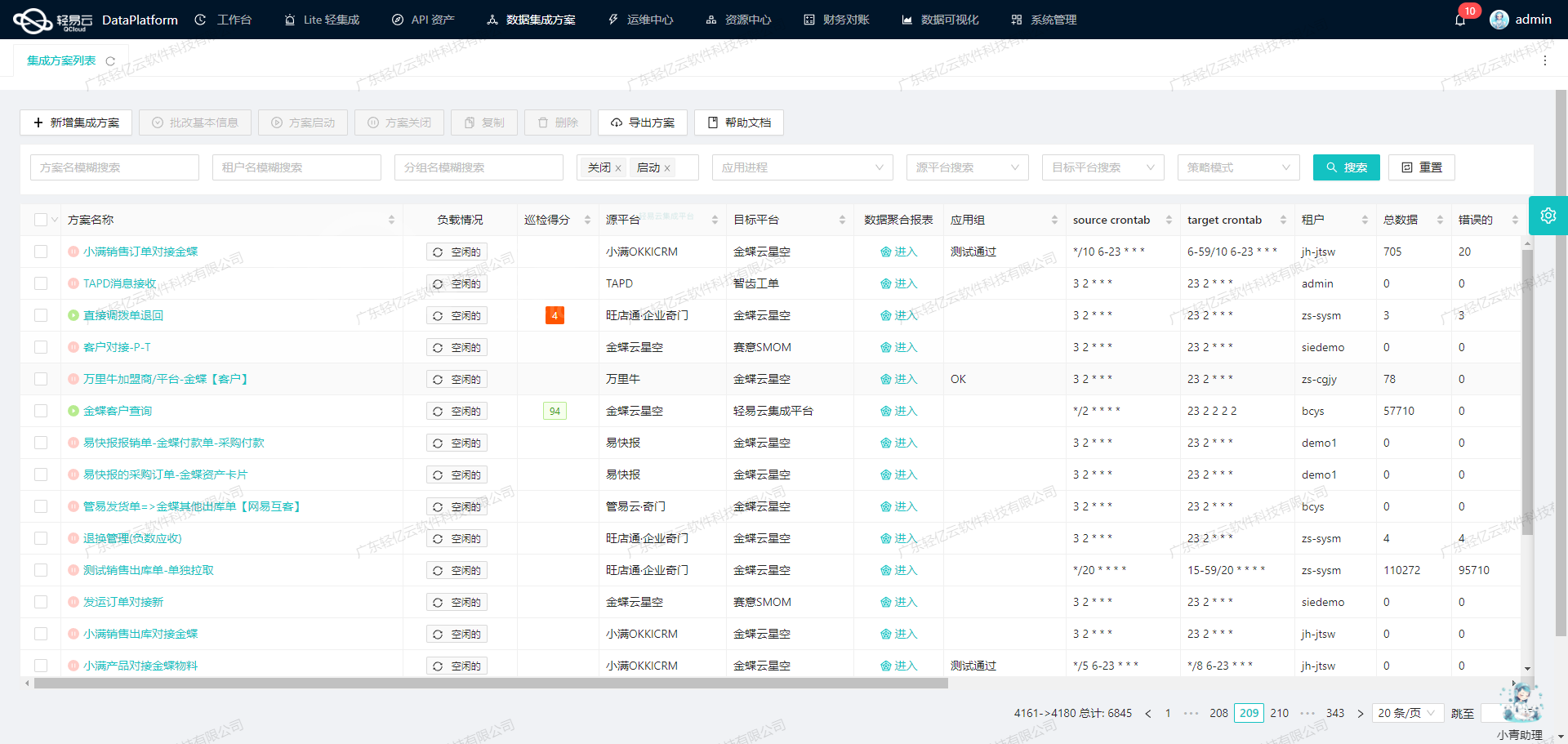

有赞云数据集成到敦煌种业先锋——用户union_id查询案例

在系统对接和数据集成的过程中,有效的数据管理和处理是实现业务价值的重要环节。本次技术案例将聚焦一个具体场景,即如何通过API接口高效地将有赞云的用户信息集成到敦煌种业先锋系统中,并确保各个阶段的数据准确性与完整性。

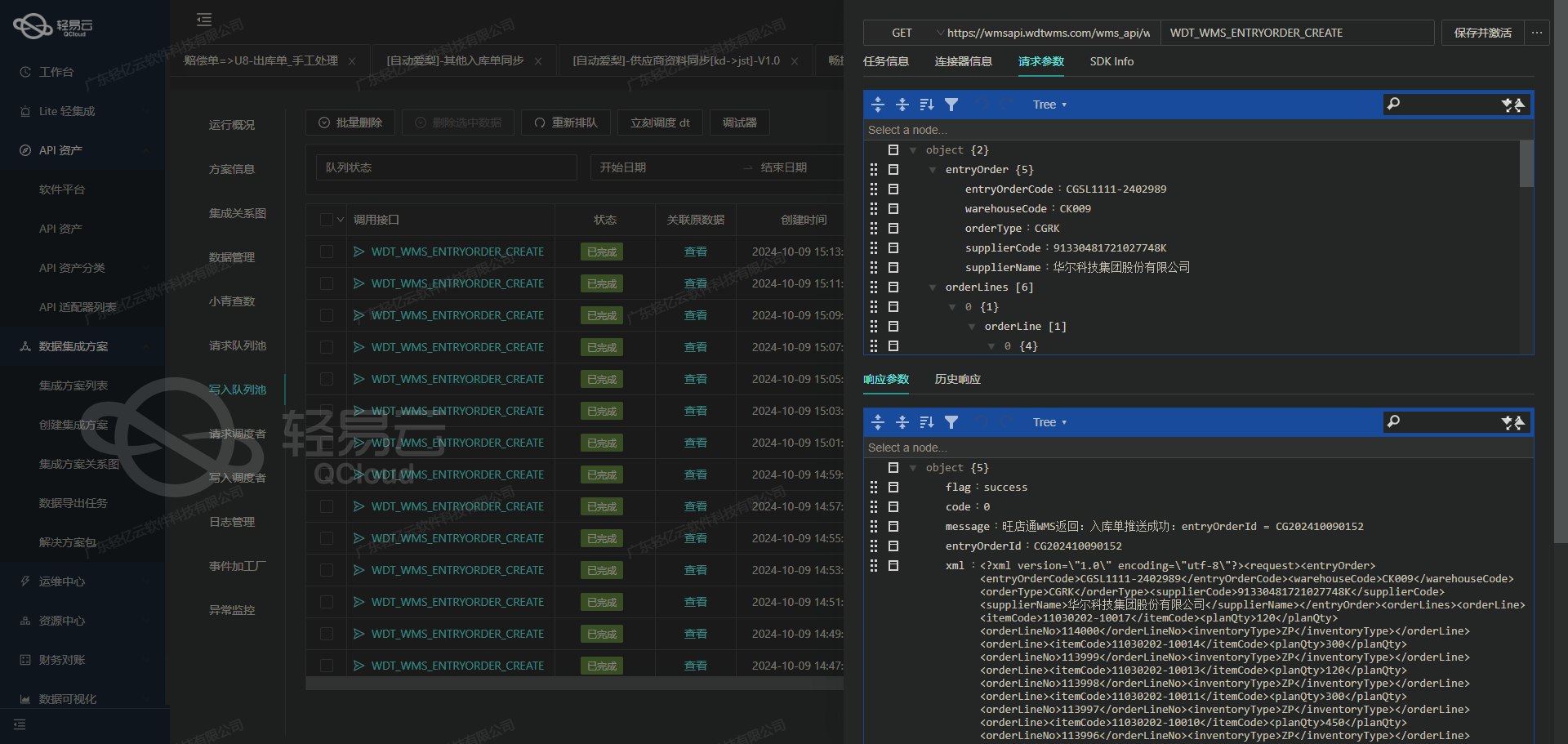

方案名称:用户union_id查询

-

获取有赞云客户列表 首先,通过调用有赞云的

/youzan.scrm.customer.list.1.0.0API接口,批量抓取客户信息。此API支持分页返回客户列表,必须妥善处理其分页机制,同时考虑到限流问题,我们需要设计稳健的数据抓取策略:{ "page_no": 1, "page_size": 100, "fields": "user.nick,user.union_id" } -

数据转换与质量监控 对于从有赞云拉取的原始数据,需要进行必要的数据转换,使之适配敦煌种业先锋所需的数据格式。在此过程中,自定义转换逻辑非常重要,我们通过轻易云提供可视化设计工具配置了如下映射规则:

有赞字段 敦煌字段 user.nick CustomerName user.union_id CustomerUnionID 在这个步骤中,为保证数据质量,实时监控和异常检测至关重要。一旦发现任何不一致或错误情况,将触发告警并启动相应的重试机制。

-

写入到敦煌种业先锋

最终经过清洗及转换后的数据,批量写入敦煌种业先锋系统。对应使用的API为

/Api/QEasyCloud/OtOCustomer,该接口具有高吞吐量能力,可迅速完成大量记录写入操作。以下为示例请求格式:{ "CustomerRecords": [ { "CustomerName": "John Doe", "CustomerUnionID": "123456789" }, ... ] } -

集中监控与日志记录

为了确保整个流程透明且可追溯,通过集中监控平台实时跟踪任务状态及性能指标,并记录每一步操作日志,以便后续优化和改进。同时,也设立了一系列关键点检查措施,如漏单检测等,以进一步保障集成过程中的可靠性。

以上简单介绍了我们在实际运行中的部分技术要点及解决方案细节,在接下来的整体框架实施中,将继续优化各模块间协作,提高系统对接效率

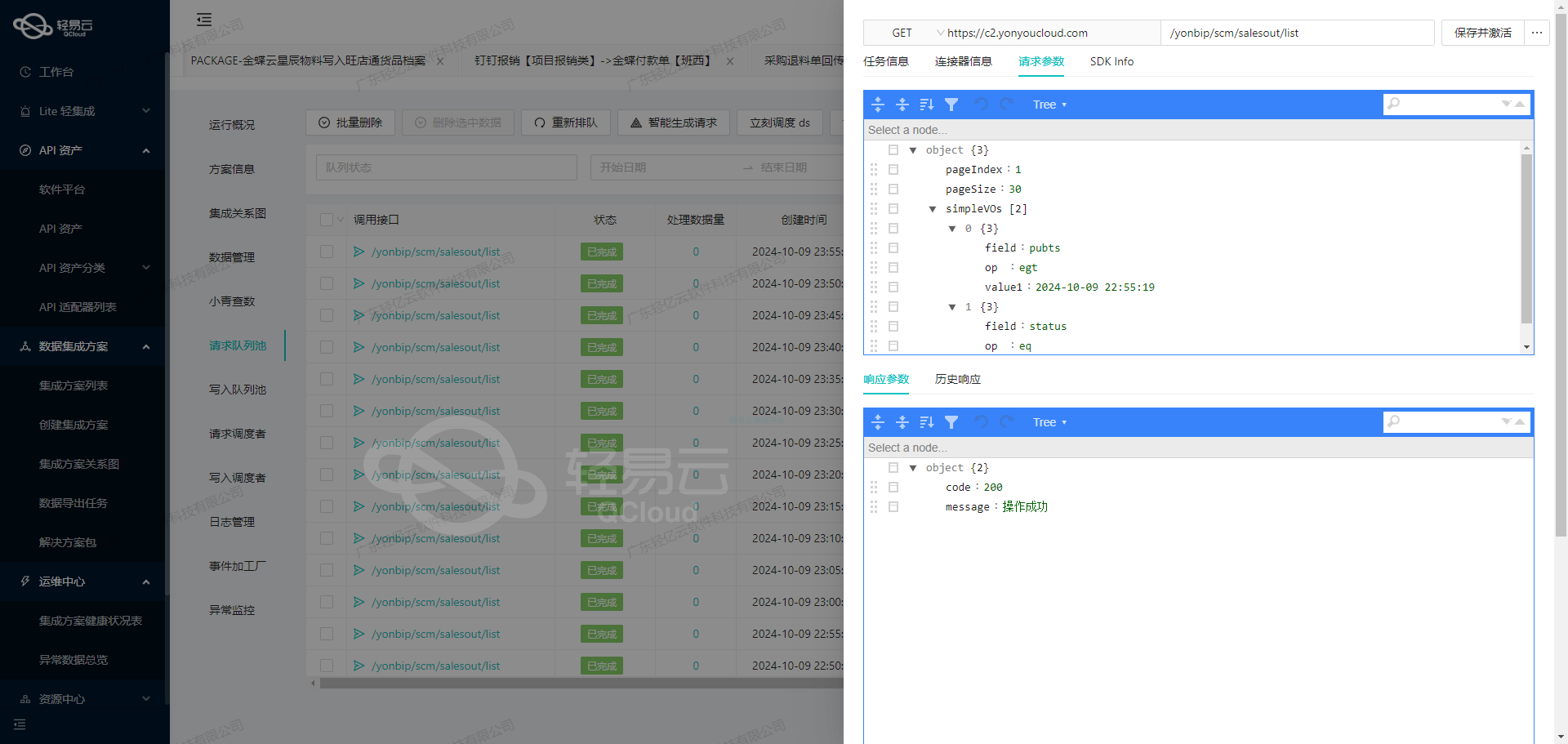

调用有赞云接口获取并加工数据的技术案例

在轻易云数据集成平台上,调用有赞云接口youzan.scrm.customer.list.1.0.0进行数据获取和加工是数据集成生命周期中的重要步骤。本文将详细探讨如何配置和使用该接口,以实现高效的数据请求与清洗。

接口配置与请求参数

首先,我们需要配置元数据以调用有赞云的API。根据提供的元数据配置,我们可以看到以下关键信息:

- API路径:

/youzan.scrm.customer.list.1.0.0 - 请求方法:GET

- 主要字段:

created_at_start:开始成为客户的时间,时间戳格式,单位是秒。created_at_end:成为客户的结束时间。has_mobile:是否有手机号。page_no:页码。page_size:每页数量。

这些字段将用于构建我们的API请求,以获取符合条件的客户列表。

请求参数设置

在实际操作中,我们需要动态设置一些参数,例如起始时间和结束时间。以下是一个示例请求参数配置:

{

"created_at_start": "{LAST_SYNC_TIME}",

"created_at_end": "{CURRENT_TIME}",

"has_mobile": "true",

"page_no": "1",

"page_size": "50"

}{LAST_SYNC_TIME}和{CURRENT_TIME}是动态变量,分别表示上次同步时间和当前时间。这些变量确保我们只获取自上次同步以来的新数据。

数据清洗与转换

在获取到原始数据后,下一步是对数据进行清洗和转换。根据元数据配置中的condition_bk字段,我们可以应用一些过滤条件。例如,只保留性别为男性(gender=1)的客户记录:

"condition_bk": [

[

{

"field": "gender",

"logic": "eqv2",

"value": "1"

}

]

]这个过滤条件将在数据清洗阶段应用,以确保最终的数据集仅包含符合条件的记录。

数据写入与自动填充响应

轻易云平台支持自动填充响应,这意味着我们可以直接将处理后的数据写入目标系统,而无需手动处理响应结果。在元数据配置中,autoFillResponse设置为true,即启用了自动填充功能。

此外,我们还可以使用其他API进行详细信息查询。例如,通过调用另一个API /youzan.user.weixin.openid.get.3.0.0 获取用户的微信OpenID,并将其与主记录关联:

"otherRequest": [

{

"field": "otherapi",

"label": "otherapi",

"type": "string",

"value": "/youzan.user.weixin.openid.get.3.0.0"

},

{

"field": "detailkey1",

"label": "详情请求参",

"type": "string",

"value": "yz_open_id"

},

{

"field": "detailkey2",

"label": "响应请求参",

"type": "string",

"value": "yz_open_id"

}

]通过这种方式,我们可以进一步丰富客户信息,使得集成的数据更加全面和准确。

实际操作步骤

- 配置API请求:根据元数据配置构建API请求参数,并发送GET请求以获取客户列表。

- 应用过滤条件:对返回的数据集应用过滤条件,例如性别筛选。

- 调用详细信息API:如果需要,可以调用其他API获取更多详细信息,并将其合并到主记录中。

- 自动填充响应:启用自动填充功能,将处理后的数据写入目标系统。

通过以上步骤,我们能够高效地从有赞云获取并加工客户数据,实现不同系统间的数据无缝对接。这不仅提升了业务透明度,还极大地提高了工作效率。

使用轻易云数据集成平台进行ETL转换并写入敦煌种业先锋API接口

在数据集成过程中,ETL(Extract, Transform, Load)转换是一个至关重要的步骤。本文将详细探讨如何使用轻易云数据集成平台,将已经集成的源平台数据进行ETL转换,并转为目标平台——敦煌种业先锋API接口所能够接收的格式,最终写入目标平台。

元数据配置解析

在进行ETL转换之前,我们首先需要了解目标API接口的元数据配置。以下是敦煌种业先锋API接口的元数据配置:

{

"api": "/Api/QEasyCloud/OtOCustomer",

"effect": "EXECUTE",

"method": "POST",

"number": "id",

"id": "id",

"name": "id",

"idCheck": true,

"request": [

{"field": "CustomerId", "label": "客户id", "type": "string", "value": "{yz_open_id}"},

{"field": "Name", "label": "用户名称(昵称)", "type": "string", "value": "{show_name}"},

{"field": "MobilePhone", "label": "手机号码", "type": "string", "value": "{mobile}"},

{"field": "Unionid", "label": "微信unionid", "type": "string", "value": "{union_id}"}

]

}该配置文件包含了API接口的基本信息,如路径、请求方法以及需要传递的数据字段等。具体字段如下:

CustomerId对应{yz_open_id}Name对应{show_name}MobilePhone对应{mobile}Unionid对应{union_id}

数据提取与清洗

在ETL过程的第一步,我们需要从源系统中提取相关数据,并对其进行清洗和预处理。这一步通常涉及到从数据库或其他存储系统中读取原始数据,并进行必要的数据清洗操作,如去除空值、格式化日期等。

假设我们从源系统中提取到以下数据:

{

"_id":"12345",

"_source":{

"_yz_open_id":"user_001",

"_show_name":"张三",

"_mobile":"13800138000",

"_union_id":"wx1234567890"

}

}数据转换

接下来,我们需要将提取到的数据按照目标API接口所需的格式进行转换。根据元数据配置,我们可以编写如下转换逻辑:

def transform_data(source_data):

transformed_data = {

'CustomerId': source_data['_source']['_yz_open_id'],

'Name': source_data['_source']['_show_name'],

'MobilePhone': source_data['_source']['_mobile'],

'Unionid': source_data['_source']['_union_id']

}

return transformed_data通过上述代码,我们将源系统中的字段映射到目标API接口所需的字段格式。

数据写入

完成数据转换后,下一步是将转换后的数据通过POST请求写入到敦煌种业先锋API接口。以下是一个使用Python实现的数据写入示例:

import requests

import json

# 转换后的数据

data_to_write = transform_data(source_data)

# API请求头

headers = {

'Content-Type': 'application/json'

}

# API请求URL

url = 'https://example.com/Api/QEasyCloud/OtOCustomer'

# 发起POST请求

response = requests.post(url, headers=headers, data=json.dumps(data_to_write))

# 检查响应状态码

if response.status_code == 200:

print("Data written successfully")

else:

print(f"Failed to write data: {response.status_code}, {response.text}")通过上述代码,我们将转换后的数据以JSON格式发送到指定的API接口,并检查响应状态以确保数据成功写入。

实时监控与错误处理

在实际应用中,实时监控和错误处理同样重要。我们可以利用轻易云平台提供的实时监控功能,跟踪每个环节的数据流动和处理状态。一旦出现错误,可以及时捕获并处理,例如记录日志、发送告警通知等。

try:

response = requests.post(url, headers=headers, data=json.dumps(data_to_write))

response.raise_for_status()

except requests.exceptions.RequestException as e:

# 记录错误日志并发送告警通知

log_error(e)

send_alert("Data write failed", str(e))通过以上步骤,我们实现了从源系统到敦煌种业先锋API接口的数据ETL转换和写入。在整个过程中,充分利用轻易云平台提供的可视化界面和实时监控功能,有效提升了业务透明度和效率。