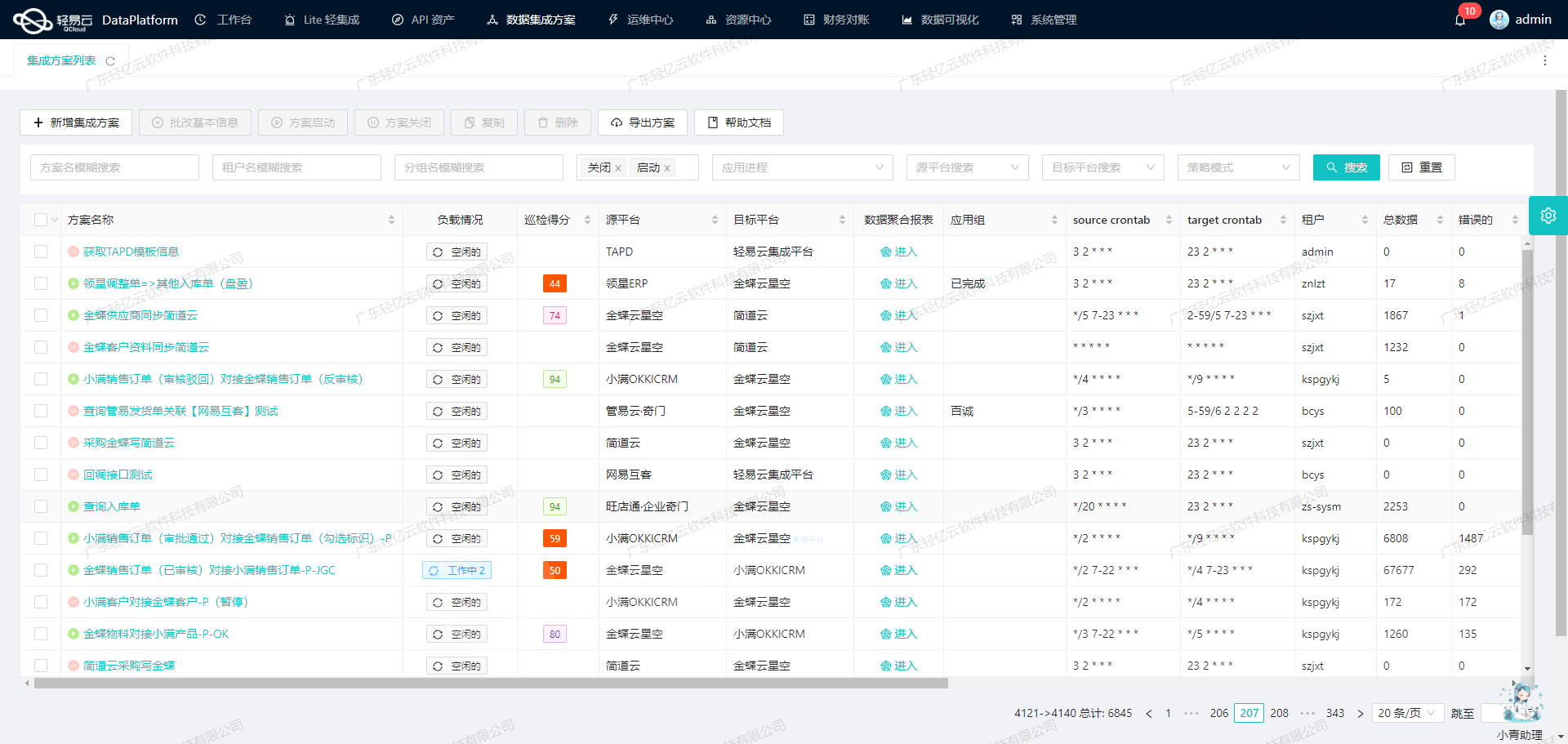

MySQL 数据集成的高效实现:一个案例探讨

在复杂多变的数据环境中,实现MySQL之间的数据无缝对接是许多企业面临的重要挑战。本技术文章将详细介绍如何利用轻易云数据集成平台,将用户与钉钉部门和人员相关的数据信息从一个MySQL数据库准确、高效地集成到另一个MySQL数据库实例。该实际运行的方案被命名为:user-钉钉部门与人员-刷新删除-OK。

这种跨系统的数据对接不仅需要处理大量实时更新的数据,还要确保每个步骤都能透明、可控。我们采用了以下关键技术特性:

-

高吞吐量数据写入能力: 我们通过优化轻易云平台中的数据传输通道,显著提升了大批量数据快速写入到目标MySQL数据库的效率,有效缩短了数据处理时间。

-

集中监控和告警系统: 在整个集成过程中,实时监控工具能够跟踪各项任务状态和性能指标,在出现异常情况时及时发出告警通知,确保问题早发现、早解决。

-

自定义数据转换逻辑: 为了适应不同业务需求,我们设计了灵活的自定义转换规则,使得源端与目标端之间的数据结构差异得到有效处理。例如,将API接口返回的select查询结果经过映射后,通过execute操作插入到目的表中,从而保持两套系统间的一致性。

-

批量操作和定时任务调度: 通过设置定时抓取机制,不仅确保新产生或更新的数据可以准时同步,还保证了在高并发情况下不会漏单。分布式架构使批量操作更具可靠性和容错能力,即使发生失败也能自动重试,大幅提高整体稳定性。

-

API资产管理功能: 利用统一视图查看和管理所有API调用的信息,包括select读取过程中的分页限流策略,以及execute写入过程中的事务控制等。这种全局掌握在配置优化方面提供重要支持,让资源使用更加合理。

本文将在随后的部分深入解析具体实施细节,并分享实践经验,以期帮助您解答MySQL间复杂集成所遇到的问题,提供更多切实可行的方法供参考。

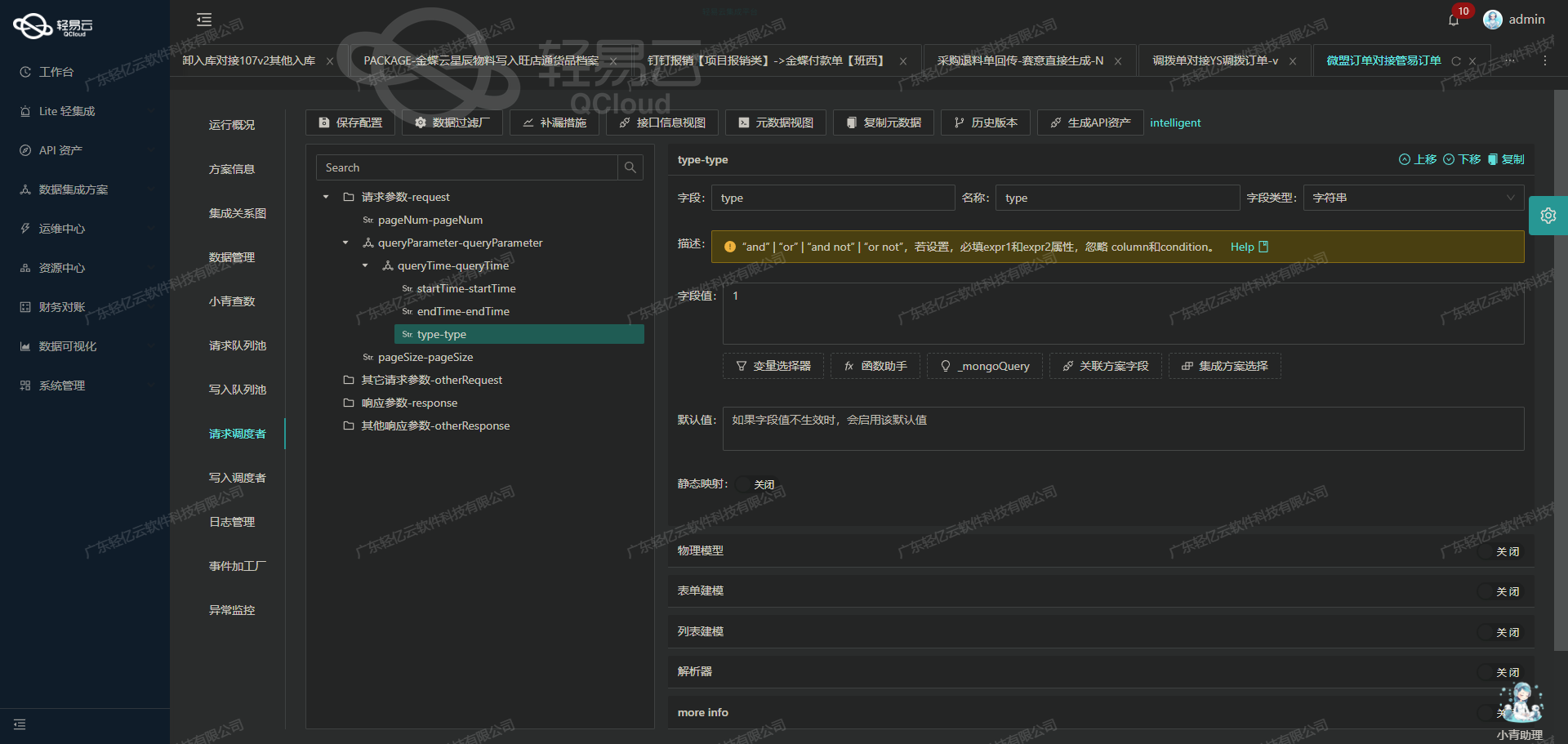

调用MySQL接口获取并加工数据的技术案例

在轻易云数据集成平台中,调用源系统MySQL接口进行数据请求与清洗是数据集成生命周期的第一步。本文将深入探讨如何通过配置元数据来实现这一过程,特别是通过select API接口获取并加工数据。

元数据配置解析

元数据配置是实现数据请求与清洗的关键。以下是我们需要关注的主要配置项:

{

"api": "select",

"effect": "QUERY",

"method": "POST",

"id": "短日期",

"idCheck": true,

"request": [

{

"field": "main_params",

"label": "主参数",

"type": "object",

"describe": "对应其它请求字段内SQL语句的主参数,必须一一对应。",

"value": "1",

"children": [

{

"field": "limit",

"label": "限制结果集返回的行数",

"type": "int",

"describe": "必要的参数!LIMIT 子句用于限制查询结果返回的行数。",

"value": "{PAGINATION_PAGE_SIZE}"

},

{

"field": "offset",

"label": "偏移量",

"type": "int",

"describe": "OFFSET 子句用于指定查询结果的起始位置或偏移量。",

"value": "{PAGINATION_START_ROW}"

}

]

}

],

...

}配置解析与应用

-

API接口与方法:

api:select表示我们使用的是SELECT查询。method:POST表示我们使用POST方法来提交请求。

-

主参数设置:

main_params包含了两个子参数:limit和offset。limit: 用于限制查询结果返回的行数。其值为{PAGINATION_PAGE_SIZE},表示分页大小。offset: 用于指定查询结果的起始位置。其值为{PAGINATION_START_ROW},表示分页起始行。

-

主SQL语句:

{ ... { "field":"main_sql", ... "value":"select now() as date1 limit :limit offset :offset" } ... }- SQL语句中使用了动态字段

:limit和:offset,这些字段将在执行时被实际值替换。

- SQL语句中使用了动态字段

实际操作步骤

-

构建SQL查询: 我们首先需要将主SQL语句中的动态字段替换为占位符。例如,将

:limit和:offset替换为问号(?):SELECT NOW() AS date1 LIMIT ? OFFSET ? -

绑定参数: 在执行查询之前,我们需要将请求参数绑定到占位符上。假设分页大小为10,起始行为20,则绑定后的SQL语句如下:

SELECT NOW() AS date1 LIMIT 10 OFFSET 20 -

执行查询: 使用轻易云平台提供的API接口,通过POST方法提交请求,并传递绑定后的参数。系统会自动处理这些参数并执行查询。

-

处理响应: 配置中的

autoFillResponse: true表示系统会自动填充响应结果,无需额外处理。

技术要点总结

- 动态字段绑定:通过占位符和参数绑定,提高了SQL语句的可读性和安全性。

- 分页处理:利用LIMIT和OFFSET实现分页查询,有效控制每次返回的数据量。

- 自动响应填充:简化了响应处理流程,提高了开发效率。

通过上述步骤,我们成功调用了MySQL接口获取并加工数据。这一过程不仅展示了轻易云平台在数据集成中的强大功能,也体现了其在处理复杂业务逻辑时的灵活性和高效性。

数据集成平台生命周期的第二步:ETL转换与写入MySQL API接口

在数据集成过程中,ETL(Extract, Transform, Load)是一个关键步骤。本文将深入探讨如何使用轻易云数据集成平台,将已经集成的源平台数据进行ETL转换,并最终写入目标平台MySQL API接口。

元数据配置解析

在本案例中,我们的目标是将钉钉部门与人员的数据刷新删除操作结果写入MySQL数据库。以下是元数据配置的详细解析:

{

"api": "execute",

"effect": "EXECUTE",

"method": "POST",

"idCheck": true,

"request": [

{

"field": "main_params",

"label": "main_params",

"type": "object",

"describe": "111",

"children": [

{

"field": "del_flag",

"label": "del_flag",

"type": "string",

"value": "1"

}

]

},

{

"field": "extend_params_1",

"label": "extend_params_1",

"type": "object",

"children": [

{

"field": "del_flag1",

"label": "del_flag1",

"type": "string",

"value": "1"

}

]

}

],

...

}从上述配置可以看出,主要涉及两个参数对象main_params和extend_params_1,它们分别包含字段del_flag和del_flag1,值均为"1"。这些参数将在后续的SQL语句中被引用。

SQL语句配置

元数据中的SQL语句配置如下:

{

...

,"otherRequest":[

{

...

,"field":"main_sql","label":"main_sql","type":"string","describe":"111","value":"update dingtalk_dept set del_flag=:del_flag where dept_id<>1"

},

{

...

,"field":"extend_sql_1","label":"extend_sql_1","type":"string","value":"update dingtalk_user set del_flag=:del_flag1"

}

]

}这里定义了两条SQL更新语句:

main_sql:update dingtalk_dept set del_flag=:del_flag where dept_id<>1extend_sql_1:update dingtalk_user set del_flag=:del_flag1

这两条语句分别用于更新钉钉部门表和用户表中的删除标志字段。

数据转换与写入过程

在实际操作中,ETL过程可以分为以下几个步骤:

步骤一:提取(Extract) 首先,从源系统(如钉钉)提取需要处理的数据。这一步通常由前一个生命周期阶段完成,这里不再赘述。

步骤二:转换(Transform)

接下来,根据元数据配置,对提取的数据进行转换。具体来说,就是将提取的数据映射到相应的参数对象中。在本例中,我们需要确保main_params.del_flag和extend_params_1.del_flag1都被正确设置为"1"。

步骤三:加载(Load) 最后,将转换后的数据通过API接口写入目标平台MySQL数据库。这一步通过执行预先定义好的SQL语句来实现。具体操作如下:

import requests

# 定义API接口URL

api_url = 'http://your-mysql-api-endpoint/execute'

# 构建请求体

payload = {

'main_params': {'del_flag': '1'},

'extend_params_1': {'del_flag1': '1'},

'main_sql': 'update dingtalk_dept set del_flag=:del_flag where dept_id<>1',

'extend_sql_1': 'update dingtalk_user set del_flag=:del_flag1'

}

# 发起POST请求

response = requests.post(api_url, json=payload)

# 检查响应状态

if response.status_code == 200:

print("Data successfully written to MySQL.")

else:

print(f"Failed to write data: {response.text}")上述代码展示了如何通过HTTP POST请求将转换后的数据写入MySQL数据库。注意,这里假设API接口URL为http://your-mysql-api-endpoint/execute,实际使用时需根据具体情况调整。

技术要点总结

- 参数对象构建:根据元数据配置构建请求参数对象,确保每个字段都被正确赋值。

- SQL语句执行:利用预定义的SQL语句,通过API接口将数据写入目标数据库。

- 错误处理:在实际操作中,应增加错误处理机制,以应对可能出现的网络问题或数据库异常。

通过上述步骤,我们实现了从源系统到目标平台MySQL数据库的数据无缝对接,为业务系统提供了可靠的数据支持。