钉钉数据集成到MySQL:dd-新薪金单(工资)-->mysql(鸿巢付款单)

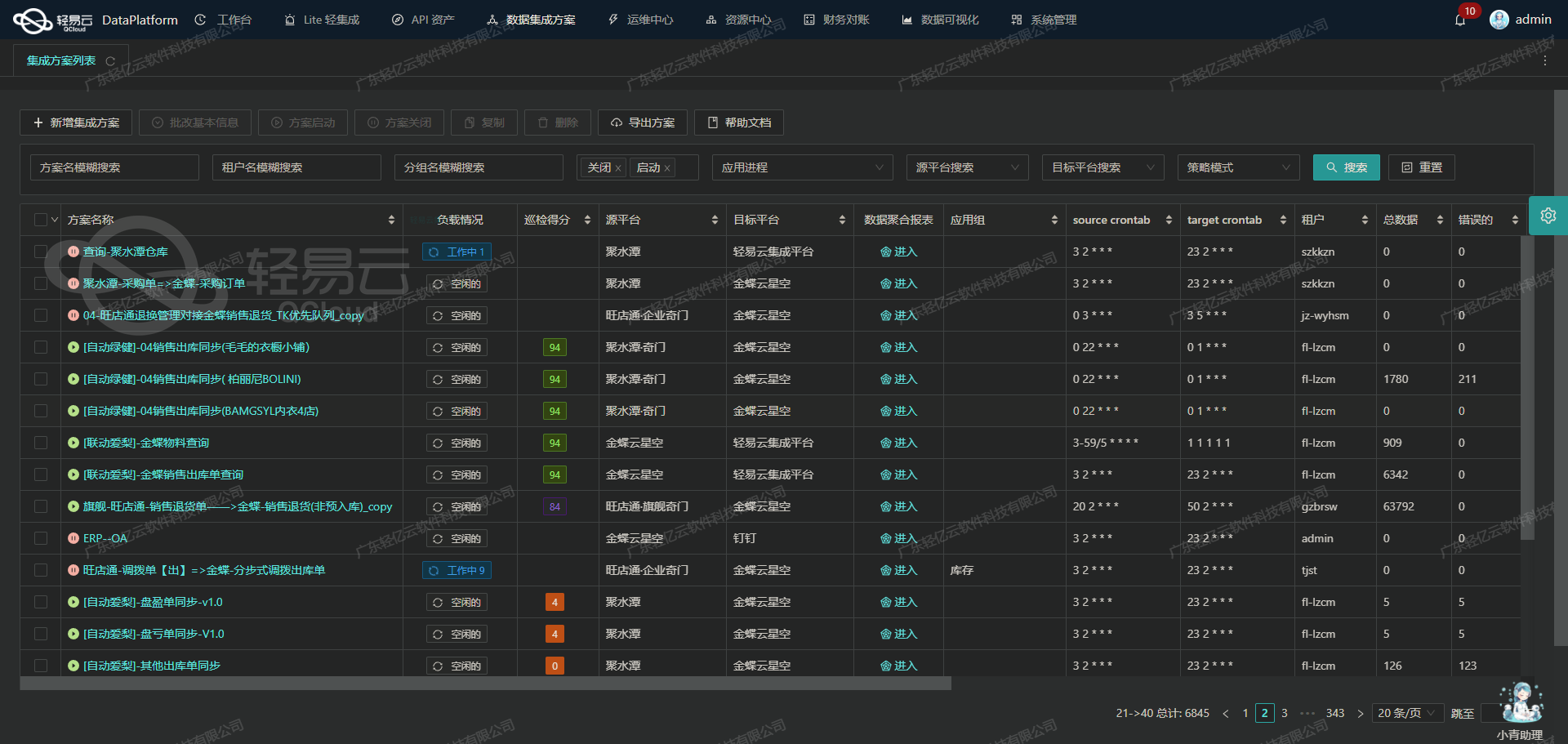

在本技术案例中,我们将深入探讨如何通过轻易云数据集成平台,将钉钉系统中的“新薪金单”数据高效、安全地集成到MySQL数据库中的“鸿巢付款单”表。此次对接方案命名为dd-新薪金单(工资)-->mysql(鸿巢付款单),旨在实现精准的数据同步,并确保每个业务环节的透明可视和高效执行。

首先,通过调用钉钉获取数据的API (v1.0/yida/processes/instances) 定时、可靠地抓取最新的薪资信息。在此过程中,需要考虑处理接口分页与限流问题,以确保大规模请求下系统稳定性。同时,基于自定义的数据转换逻辑,将原始数据映射至符合公司内部需求的结构格式,这有助于解决两者之间可能存在的数据格式差异。

在写入环节,通过 MySQL 写入 API (execute) 提供批量、高吞吐量的数据写入能力,使得来自钉钉的大量薪资条目能够快速被导入 MySQL 数据库中。这不仅优化了系统资源使用,还显著提升了整体数据处理效率。值得注意的是,为应对潜在的数据质量问题及异常情况,配置了实时监控和告警系统,可以及时发现并处理各类异常,从而保证整个流程平稳运行。

此外,在操作过程中还引入了定制化数据映射以及错误重试机制,这些措施极大提高了系统对边缘情况的容错能力,并确保所有关键任务都能顺利完成。当整合工作进入最后阶段时,可利用轻易云提供的可视化工具,对全生命周期进行管理和跟踪,使每一步操作都变得清晰直观,便捷掌握。

以上就是我们即将详细解析与展示内容的小开端,在后续部分,我们将具体阐述各步实施细节及其技术要点。

调用钉钉接口获取并加工数据

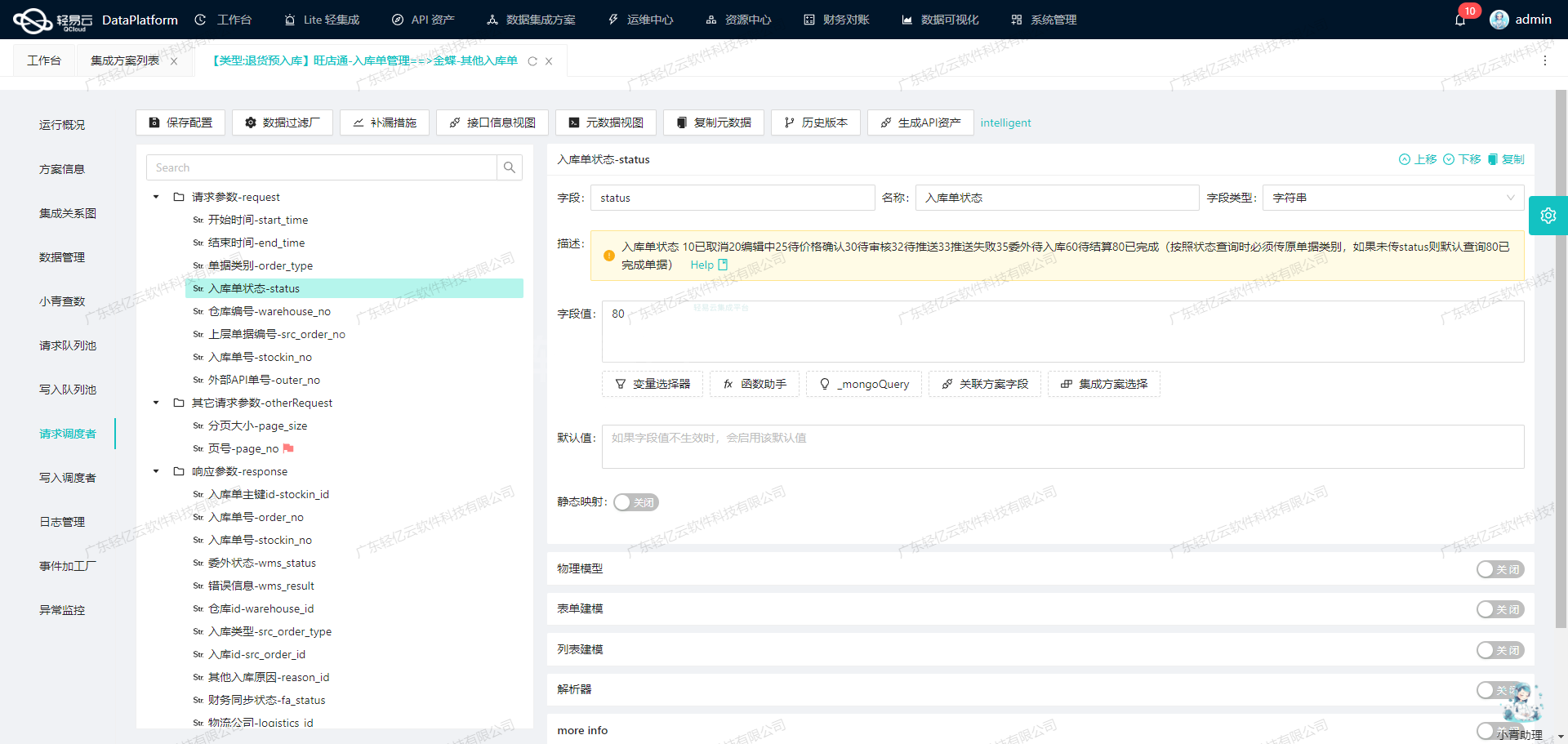

在数据集成的生命周期中,调用源系统接口是至关重要的一步。本文将详细探讨如何通过轻易云数据集成平台调用钉钉接口v1.0/yida/processes/instances获取数据,并对其进行必要的加工处理。

接口配置与请求参数

首先,我们需要配置API接口及其请求参数。根据提供的元数据配置,接口为POST方法,具体参数如下:

- 分页页码 (

pageNumber): 用于控制分页查询的起始页码,值为{PAGINATION_START_PAGE}。 - 分页大小 (

pageSize): 用于控制每页返回的数据量,值为{PAGINATION_PAGE_SIZE}。 - 应用ID (

appType): 固定值APP_WTSCMZ1WOOHGIM5N28BQ。 - 应用秘钥 (

systemToken): 固定值IS866HB1DXJ8ODN3EXSVD750RBTK2X72R8MELL4。 - 用户ID (

userId): 固定值16000443318138909。 - 语言 (

language): 默认值为zh_CN(中文)。 - 表单ID (

formUuid): 固定值FORM-0A966I81H10AX9NTBHCRX9JYRM0X2DS1D2MGLL。 - 条件查询 (

searchFieldJson):- 类型 (

selectField_lgn2qshb):固定值工资 - 流水号 (

serialNumberField_lgovkejx)

- 类型 (

- 创建时间起始值 (

createFromTimeGMT):计算当前时间减去25天,格式化为%Y-%m-%d 00:00:00 - 创建时间终止值 (

createToTimeGMT):当前时间 - 实例状态 (

instanceStatus):固定值COMPLETED - 流程审批结果 (

approvedResult):固定值agree

数据请求与清洗

在发送请求后,我们会接收到一个包含多个字段的JSON响应。为了便于后续的数据处理和存储,我们需要对响应数据进行清洗和转换。以下是具体的字段转换规则:

- 将字段

dateField_lgn2qsju转换为新的字段名datetime_new,格式为日期类型。 - 将字段

serialNumberField_lgovkejx转换为新的字段名order_no_new,格式为字符串类型。

这些转换规则确保了我们能够将原始数据标准化,并且符合目标系统(如MySQL数据库)的要求。

数据转换与写入

在完成数据清洗后,我们需要将处理后的数据写入目标系统。在本案例中,目标系统是MySQL数据库中的鸿巢付款单表。以下是一个简单的数据写入示例:

INSERT INTO hongchao_payment_order (datetime_new, order_no_new, other_fields)

VALUES (?, ?, ?);在实际操作中,我们可以利用轻易云平台提供的可视化界面和自动化工具,将上述SQL语句嵌入到工作流中,实现全自动的数据处理和写入。

实际案例应用

假设我们需要从钉钉获取最近25天内所有已完成且审批结果为同意的工资单实例,并将其导入到MySQL数据库中。我们可以按照以下步骤进行操作:

- 配置API请求参数,如上所述。

- 发送请求并接收响应数据。

- 根据元数据配置,对响应数据进行清洗和转换。

- 将清洗后的数据批量写入MySQL数据库。

通过这种方式,我们不仅实现了不同系统间的数据无缝对接,还确保了数据的一致性和准确性。这种方法极大地提高了业务流程的透明度和效率,为企业的数据管理提供了强有力的支持。

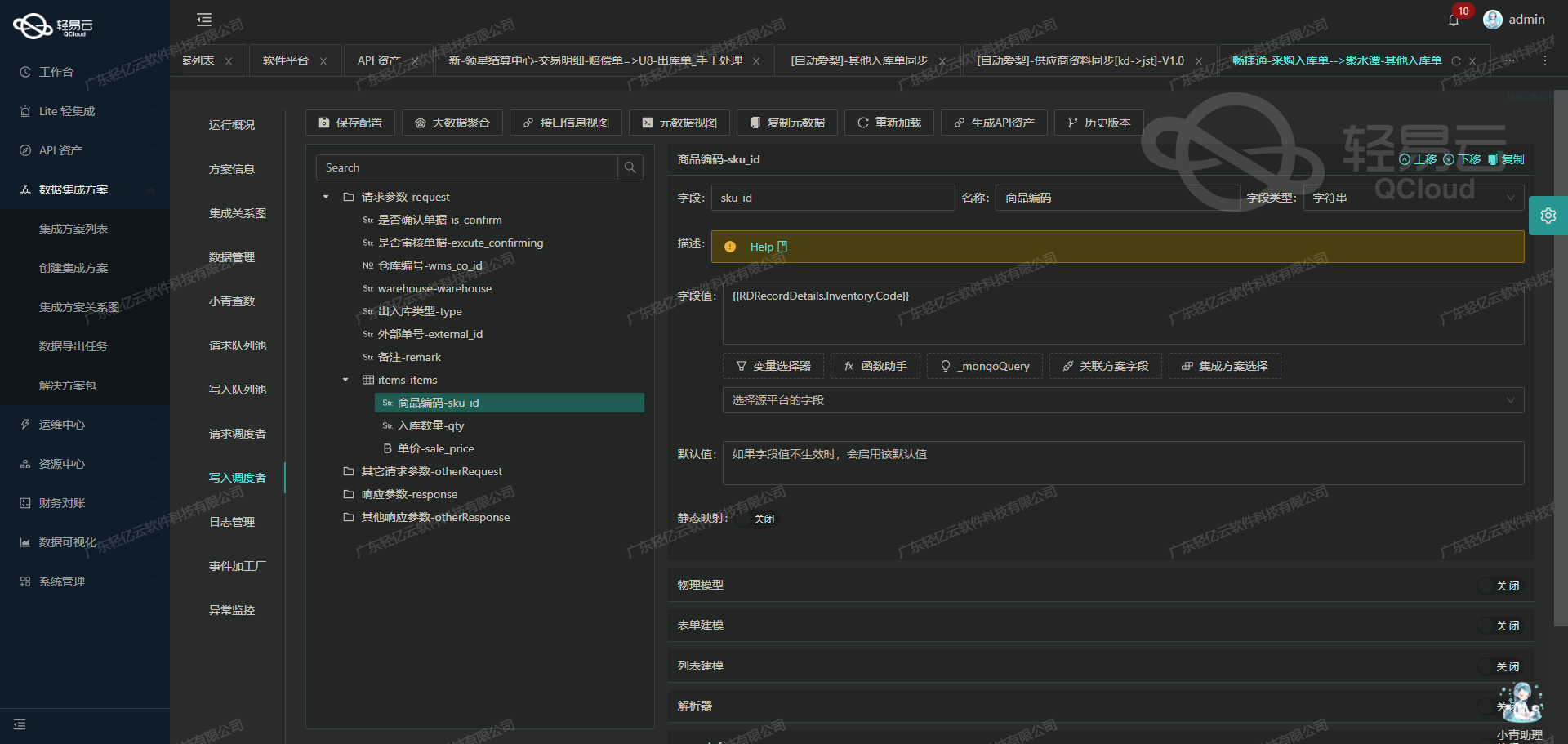

使用轻易云数据集成平台进行ETL转换并写入MySQLAPI接口

在数据集成生命周期的第二步,我们将重点讨论如何将已经集成的源平台数据进行ETL转换,并转为目标平台 MySQLAPI接口所能够接收的格式,最终写入目标平台。本文将深入探讨系统接口和数据集成的特性,结合具体的元数据配置进行详细说明。

API接口元数据配置解析

根据提供的元数据配置,我们需要将源平台的数据通过ETL流程转换为MySQL数据库能够接受的格式,并通过API接口写入目标表hc_dd_fkd。以下是元数据配置的详细解析:

{

"api": "execute",

"effect": "EXECUTE",

"method": "POST",

"idCheck": true,

"request": [

{

"field": "main_params",

"label": "main_params",

"type": "object",

"describe": "111",

"children": [

{"field": "extend_processInstanceId", "label": "明细id", "type": "string", "value":"{bfn_id}"},

{"field": "order_no_new", "label": "单号", "type": "string", "value":"{order_no_new}(FKD)"},

{"field": "datetime_new", "label": "时间", "type": "date", "value":"{datetime_new}"},

{"field": "qty_count", "label":"数量","type":"string","value":"1"},

{"field":"sales_count","label":"金额","type":"string","value":"{{tableField_lgn2qsk9_numberField_lgn2qski}}"},

{"field":"status","label":"状态","type":"string"},

{"field":"Document_Type","label":"单据类型","type":"string","value":"付款单"}

]

}

],

...

}数据请求与清洗

在数据请求阶段,我们从源平台获取相关的数据字段,例如bfn_id、order_no_new、datetime_new等。这些字段将被用来填充目标平台所需的数据结构。在清洗过程中,需要确保每个字段的数据类型和格式符合目标平台的要求。例如,将日期格式化为MySQL能够识别的标准日期格式。

数据转换与写入

在转换阶段,我们使用ETL工具对数据进行处理,使其符合MySQLAPI接口所需的格式。以下是关键步骤:

-

字段映射与转换:

extend_processInstanceId: 映射到源数据中的bfn_idorder_no_new: 映射到源数据中的order_no_new并附加固定后缀“(FKD)”datetime_new: 转换为标准日期格式qty_count: 固定值“1”sales_count: 映射到源数据中的金额字段status: 根据业务逻辑设置状态值Document_Type: 固定值“付款单”

-

构建请求体: 根据上述映射关系,构建POST请求体,使其符合API接口规范。

{

“main_params”: {

“extend_processInstanceId”: “12345”,

“order_no_new”: “ORD12345(FKD)”,

“datetime_new”: “2023-10-01”,

“qty_count”: “1”,

“sales_count”: “1000.00”,

“status”: “Completed”,

“Document_Type”: “付款单”

}

}- 执行SQL插入操作: 使用预定义的SQL语句,将构建好的请求体参数插入到目标表中。

INSERT INTO `hc_dd_fkd`

(`extend_processInstanceId`, `order_no_new`, `datetime_new`, `qty_count`, `sales_count`, `status`, `Document_Type`)

VALUES (:extend_processInstanceId, :order_no_new, :datetime_new, :qty_count, :sales_count, :status, :Document_Type);实际案例应用

假设我们有一条源平台的数据记录如下:

{

“bfn_id”: “12345”,

“order_no_new”: “ORD12345”,

“datetime_new”: “2023-10-01T12:00:00Z”,

...

}通过ETL流程,我们将其转换为如下格式,并通过API接口写入MySQL数据库:

{

“main_params”: {

“extend_processInstanceId”: “12345”,

“order_no_new”: “ORD12345(FKD)”,

“datetime_new”: “2023-10-01”,

...

}

}执行上述SQL语句后,该记录将成功插入到目标表hc_dd_fkd中。

总结

本文详细介绍了如何利用轻易云数据集成平台进行ETL转换,并将处理后的数据通过MySQLAPI接口写入目标数据库。通过解析元数据配置和实际案例应用,展示了完整的数据处理流程,为实现不同系统间的数据无缝对接提供了技术参考。