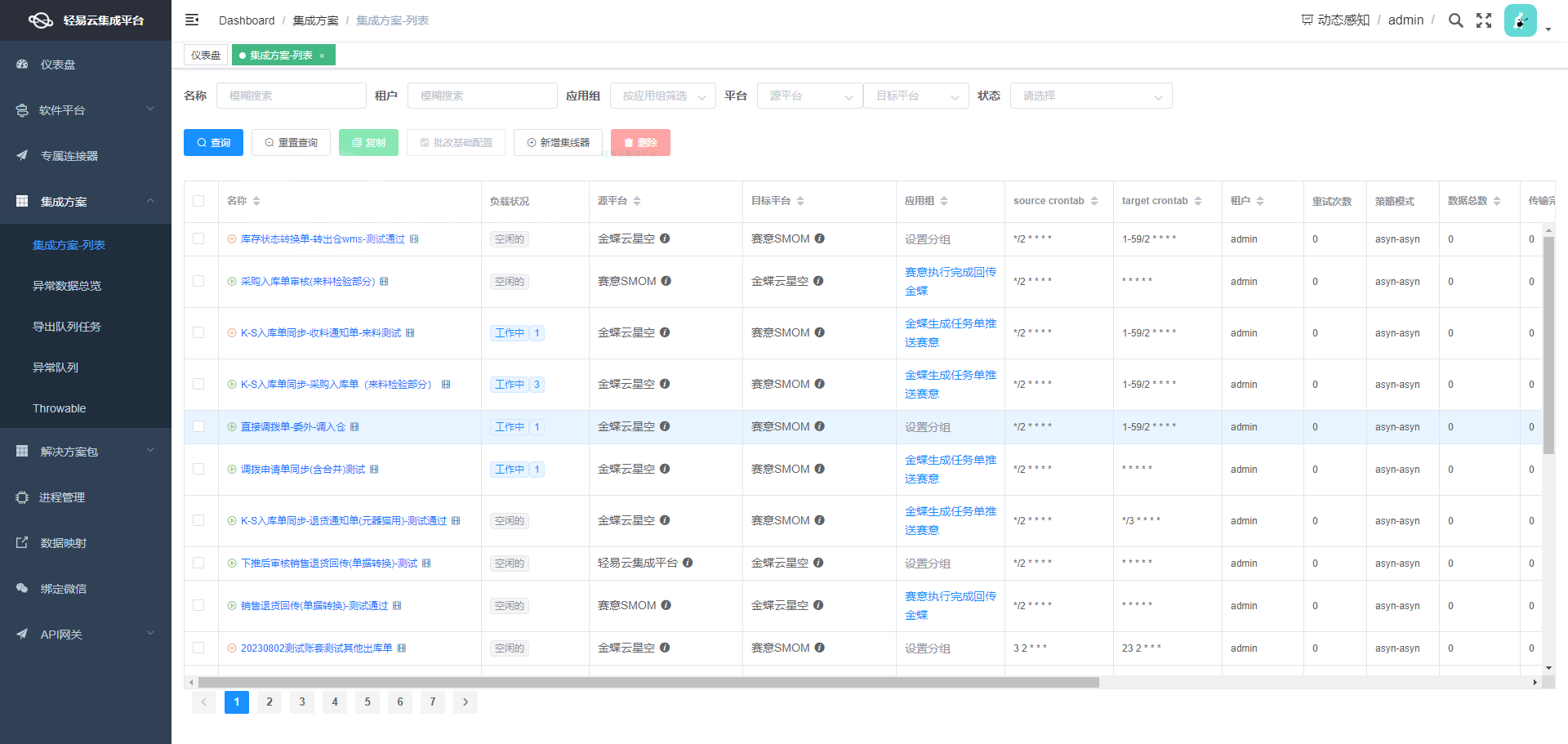

更新班牛货品:基于轻易云平台的系统对接案例分享

在本次技术分享中,我们将详细探讨如何通过轻易云数据集成平台,实现班牛与班牛之间的数据高效对接,特别是针对“更新班牛货品”这一具体方案。此解决方案核心任务是利用API接口获取和写入数据,以实现两个班牛系统间的数据同步。

1. 数据获取与处理

首先,通过调用task.list API接口从第一个班牛系统抓取货品数据。由于涉及大量数据,以及可能存在的分页和限流问题,我们需要设计一个定时可靠的任务,确保所有请求都能顺利完成且不漏单。在这个过程中,可以利用自定义的数据转换逻辑,对抓取到的数据进行预处理,以适应目标系统的结构需求。

2. 数据质量监控与异常检测

在实际操作中,不可避免地会遇到一些异常情况,如网络延迟、API限制等。因此,在每个数据处理环节引入了实时监控和告警机制,一旦发现问题能够及时响应。此外,还配置了完整的日志记录功能,用于追踪每个请求和响应,为后续问题排查提供依据。

3. 数据快速写入及批量更新

获取并处理完原始数据后,下一步便是通过task.update API接口,将这些信息快速而准确地写入第二个班牛系统。这一阶段不仅要求高吞吐量,更要确保在大规模数据交互中的可靠性。为此,采用了分批次写入策略,与此同时结合重试机制,以防止因突发错误导致部分数据未能成功传输。

以上步骤展示了我们如何利用轻易云强大的集成能力,实现不同系统之间无缝衔接,从而提升业务运转效率。当然,这只是开头部分,稍后的内容将进一步深入细致解读具体实施过程、遇到的问题及其解决办法。

调用源系统班牛接口task.list获取并加工数据

在数据集成生命周期的第一步中,调用源系统的API接口是关键的一环。本文将深入探讨如何通过轻易云数据集成平台调用班牛的task.list接口,并对获取的数据进行加工处理。

元数据配置解析

首先,我们需要理解元数据配置中的各个字段及其作用。以下是对提供的元数据配置的详细解析:

{

"api": "task.list",

"effect": "QUERY",

"method": "GET",

"number": "-1",

"id": "-1",

"idCheck": true,

"request": [

{"field": "project_id", "label": "群组ID", "type": "string", "value": "27912"},

{"field": "page_size", "label": "page_size", "type": "string", "value": "100"},

{"field": "page_num", "label": "page_num", "type": "string", "value": "1"},

{"field": "star_created", "label": "起始时间", "type": "string"},

{"field": "end_created", "label": "结束时间", "type": "string"},

{"field": "star_modified",

"label":

"修改时间起始时间",

"type":"string",

"value":"_function DATE_FORMAT(DATE_ADD(NOW(),INTERVAL - 24 HOUR),'%Y-%m-%d %H:%i:%s')"

},

{"field":"end_modified","label":"修改时间结束时间","type":"string","value":"{{CURRENT_TIME|datetime}}"},

{"field":"task_status","label":"工作状态","type":"string"}

],

“autoFillResponse”: true,

“condition_bk”: [[]]

}api: 指定要调用的API接口,这里是task.list。effect: 表示操作类型,这里是查询(QUERY)。method: HTTP请求方法,这里是GET。number和id: 用于标识请求,通常用于分页或唯一性检查。idCheck: 是否进行ID检查,设置为true表示需要检查。request: 请求参数列表,包括字段名、标签、类型和默认值。

调用API并获取数据

在轻易云平台上,我们可以通过配置上述元数据来调用班牛的task.list接口。以下是具体步骤:

-

配置请求参数:

project_id: 固定值为27912,用于指定群组ID。page_size: 每页返回的数据条数,设置为100。page_num: 当前页码,初始值为1。star_created和end_created: 可选的起始和结束创建时间,用于过滤任务。star_modified: 修改时间起始时间,默认值为当前时间前24小时。end_modified: 修改时间结束时间,默认值为当前时间。task_status: 可选的任务状态,用于进一步过滤任务。

-

发送HTTP GET请求: 使用上述参数构建URL,并发送HTTP GET请求以获取任务列表。例如:

GET /api/task.list?project_id=27912&page_size=100&page_num=1&star_modified=2023-10-01%2000:00:00&end_modified=2023-10-02%2000:00:00 -

处理响应数据: 响应的数据通常是JSON格式。轻易云平台支持自动填充响应(autoFillResponse),这意味着我们可以直接使用响应中的数据进行后续处理。

数据加工与清洗

获取到原始数据后,需要对其进行清洗和加工,以便后续的数据转换与写入。以下是常见的数据清洗与加工步骤:

-

字段映射: 将原始数据中的字段映射到目标系统所需的字段。例如,将班牛任务列表中的任务ID映射到目标系统中的唯一标识符。

-

数据过滤: 根据业务需求过滤不必要的数据。例如,只保留状态为“完成”的任务。

-

格式转换: 将日期、数字等字段转换为目标系统所需的格式。例如,将日期格式从

YYYY-MM-DD HH:mm:ss转换为ISO8601标准格式。 -

增量更新: 使用修改时间(如

star_modified和end_modified)实现增量更新,只处理最近24小时内修改过的任务。

实践案例

假设我们需要将班牛中的任务列表同步到另一个系统中,并且只同步最近24小时内修改过的任务。我们可以按照以下步骤进行:

- 配置元数据,如上所述,设置好各个请求参数。

- 调用API获取任务列表,并自动填充响应数据。

- 对响应数据进行清洗和加工,包括字段映射、数据过滤和格式转换。

- 将处理后的数据写入目标系统,实现无缝对接。

通过以上步骤,我们可以高效地实现不同系统间的数据集成,并确保每个环节都透明可控。这不仅提升了业务效率,还增强了系统间的数据一致性和可靠性。

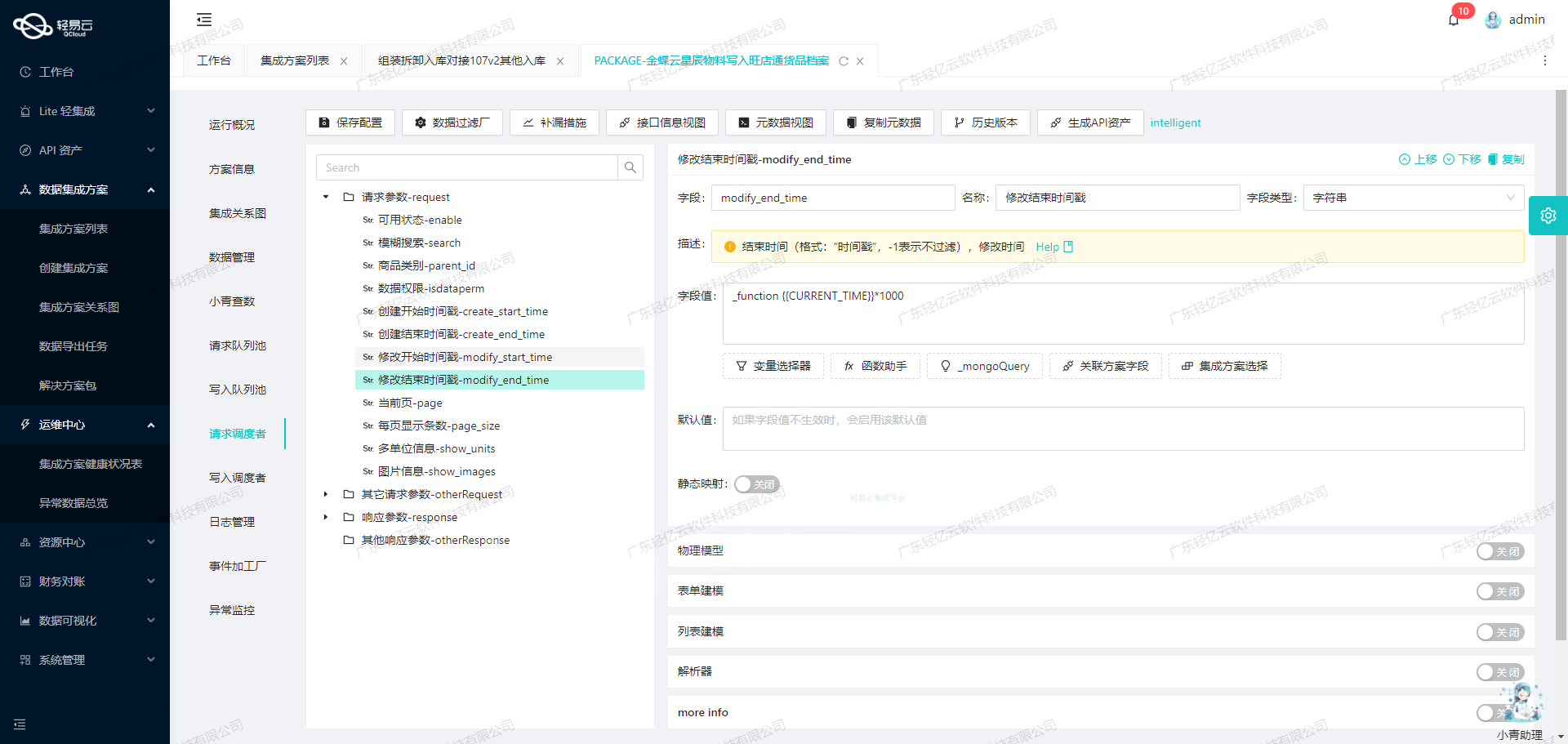

使用轻易云数据集成平台进行ETL转换并写入班牛API接口

在数据集成生命周期的第二步,我们需要将已经集成的源平台数据进行ETL(Extract, Transform, Load)转换,并转为目标平台班牛API接口所能够接收的格式,最终写入目标平台。本文将详细探讨如何通过轻易云数据集成平台实现这一过程。

API接口与元数据配置解析

我们使用的API接口为task.update,该接口的作用是更新班牛系统中的货品信息。以下是该接口的具体元数据配置:

{

"api": "task.update",

"effect": "EXECUTE",

"method": "POST",

"idCheck": true,

"request": [

{"field":"app_id","label":"小程序id","type":"int","value":"17000"},

{"field":"project_id","label":"群组ID","type":"int","value":"27912"},

{"field":"task_id","label":"工单id","type":"int","value":"{{-1}}"},

{"field":"contents","label":"contents","type":"object","children":[

{"field":"101297","label":"商品条码","type":"string","value":"_mongoQuery a97d423e-52f5-3d6f-9f94-39a9f43f2bd5 findField=content.skuBarcode where={\"content.goodsNo\":{\"$eq\":\"{{27963}}\"}}"}

]}

]

}数据请求与清洗

首先,我们需要从源系统中请求到相关的数据,并对其进行清洗。这里涉及到一个MongoDB查询,用于获取特定条件下的数据:

"_mongoQuery a97d423e-52f5-3d6f-9f94-39a9f43f2bd5 findField=content.skuBarcode where={\"content.goodsNo\":{\"$eq\":\"{{27963}}\"}}"该查询用于从MongoDB数据库中查找goodsNo等于27963的记录,并提取其skuBarcode字段。这一步骤确保我们获取到的数据是准确且符合要求的。

数据转换

接下来,我们需要对请求到的数据进行转换,以符合班牛API接口所需的格式。在元数据配置中,contents字段被定义为一个对象,其子字段包括商品条码:

{"field":"101297","label":"商品条码","type":"string"}通过上述配置,我们可以将MongoDB查询结果中的商品条码映射到班牛API接口所需的字段中。

数据写入

最后一步是将转换后的数据写入班牛系统。根据元数据配置,使用HTTP POST方法调用task.update API接口,将处理后的数据发送至班牛系统:

{

"app_id": 17000,

"project_id": 27912,

"task_id": -1,

"contents": {

"101297": "<商品条码>"

}

}在这个过程中,确保所有必需字段都已正确填充,并且JSON结构符合API要求。

实践案例

假设我们从源系统获取到了以下记录:

{

"goodsNo": "27963",

"skuBarcode": "1234567890"

}根据上述元数据配置和ETL流程,最终生成并发送给班牛API接口的数据如下:

{

"app_id": 17000,

"project_id": 27912,

"task_id": -1,

"contents": {

"101297": "1234567890"

}

}通过轻易云数据集成平台,我们能够高效地完成从源系统到目标平台的数据转换和写入,实现不同系统间的数据无缝对接。