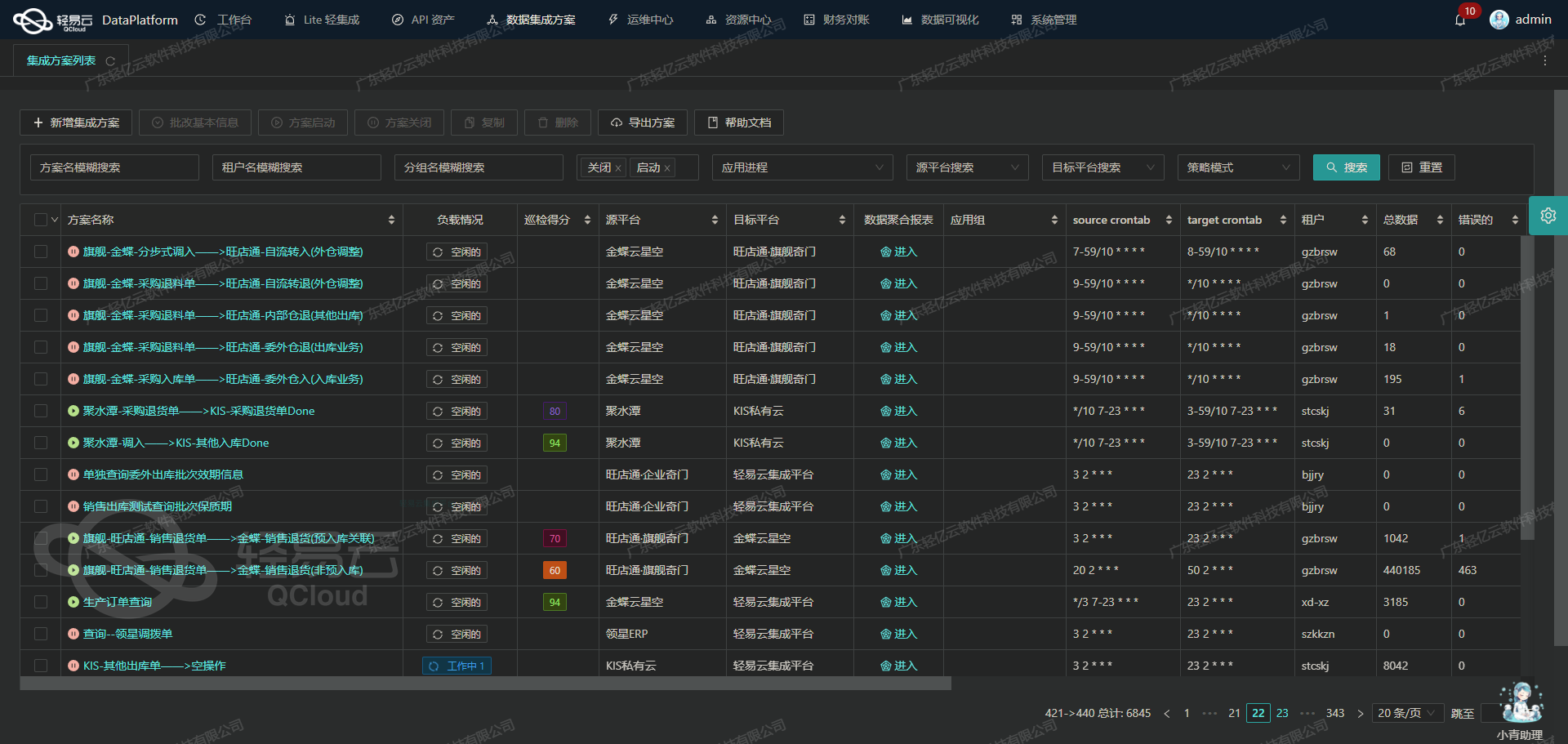

吉客云数据集成到轻易云平台:店铺查询案例分享

在本次技术案例中,我们将全面探讨如何通过轻易云数据集成平台实现吉客云(Geek Cloud)的系统对接,具体以店铺查询为例。本文旨在揭示从吉客云提取销售信息并批量写入至轻易云平台的完整过程,重点聚焦于API接口调用、分页限流处理和异常处理机制等关键技术环节。

高效抓取与确保不漏单

首先,为了能够从吉客云准确抓取所有必要的销售数据,我们利用了其提供的erp.sales.get API接口。在实际项目操作中,多数企业会面临数据体量巨大、传输速率要求高的问题。因此,在这里我们采用了定时可靠的数据抓取策略,以确保每一条重要记录都能及时、安全地获取,不遗漏任何关键信息。

批量快速写入

在完成数据抓取后,将大量的数据快速、高效地写入至轻易云平台也是一个相当关键的步骤。通过使用轻易云特有的“写入空操作”API,实现批量化、高并发的数据导入。这个过程中,考虑到了可能出现的网络波动或服务暂时不可用的问题,通过自动重试机制来保证最终一致性。

处理分页与限流问题

对于大规模的数据集成任务来说,分页和限流是两个需要特别关注的问题。在调用吉客云API进行大规模数据采集时,通过合理设置分页参数和控制请求频率,可以有效避免服务器端负载过高及因限流导致的数据丢失。而这些配置参数则可以灵活调整,以适应不同业务场景下对实时性和性能优化需求。

数据格式转换与映射

由于吉客云与轻易云之间存在较大的数据格式差异,为此我们引入了自定义字段映射配置功能。这不仅使得来自不同源头的数据能够无缝对接,还能根据实际业务需求做出相应调整。借助该功能,在保持原始数据信息完整性的同时,也提升了跨系统间沟通效率。

这一系列方法论结合应用以及各自的实现细节,将在极大程度上提高系统稳定性和整体运行效率,并帮助企业获得更加细致全面的信息化管理能力。从而真正实现多元异构驱动下的信息合规整合。这也正是我们此次分享这个具体案例——"店铺查询"的重要意义所在。

下一步,我们将深入探讨上述方法论具体实施中的代码示例及相关架构设计思路。

调用吉客云接口erp.sales.get获取并加工数据的技术实现

在数据集成的生命周期中,调用源系统接口是至关重要的一步。本文将详细探讨如何通过轻易云数据集成平台调用吉客云接口erp.sales.get,并对获取的数据进行初步加工。

接口调用配置

首先,我们需要根据元数据配置来设置API调用参数。以下是元数据配置的详细内容:

{

"api": "erp.sales.get",

"method": "POST",

"number": "channelName",

"id": "channelCode",

"pagination": {

"pageSize": 50

},

"request": [

{"field": "pageIndex", "label": "页码(默认0)", "type": "string", "change": "固定=>int"},

{"field": "pageSize", "label": "每页页数(默认50)", "type": "string", "value":"50", "change":"固定=>int"},

{"field": "code", "label": "编号", "type": "string"},

{"field": "name", "label": "名称", "type": "string"}

]

}请求参数解析与构建

根据上述配置,我们需要构建请求参数。以下是一个示例请求体:

{

"pageIndex": 0,

"pageSize": 50,

"code": "",

"name": ""

}其中,pageIndex和pageSize为分页参数,默认值分别为0和50。其他字段如code和name可以根据具体需求进行填充。

数据请求与清洗

在发起API请求后,我们会得到一个包含销售数据的响应。假设响应格式如下:

{

"data": [

{

"channelCode": "001",

"channelName": "店铺A",

// 更多字段...

},

{

"channelCode": "002",

"channelName": "店铺B",

// 更多字段...

}

// 更多记录...

],

// 分页信息等其他字段...

}我们需要对这些数据进行清洗和转换,以便后续处理。在轻易云平台上,可以通过可视化界面配置数据清洗规则,例如删除无用字段、重命名字段等。

数据转换与写入

在完成数据清洗后,需要将其转换为目标系统所需的格式,并写入目标数据库或系统。这一步通常涉及以下操作:

- 字段映射:将源系统中的字段映射到目标系统中的相应字段。例如,将

channelCode映射到目标系统中的store_id。 - 数据类型转换:确保所有字段的数据类型符合目标系统要求。例如,将字符串类型的日期转换为日期类型。

- 批量写入:为了提高效率,可以采用批量写入方式,将多个记录一次性写入目标数据库。

以下是一个示例代码片段,用于将清洗后的数据批量写入目标数据库:

import requests

import json

# 发起API请求

response = requests.post("https://api.jikecloud.com/erp.sales.get", json={

'pageIndex': 0,

'pageSize': 50,

'code': '',

'name': ''

})

# 获取响应数据

data = response.json().get('data', [])

# 清洗和转换数据

cleaned_data = []

for record in data:

cleaned_record = {

'store_id': record['channelCode'],

'store_name': record['channelName'],

# 更多字段映射...

}

cleaned_data.append(cleaned_record)

# 批量写入目标数据库(示例)

def batch_write_to_db(data):

# 假设使用某个数据库连接库,如SQLAlchemy

from sqlalchemy import create_engine, Table, MetaData

engine = create_engine('mysql+pymysql://user:password@host/dbname')

metadata = MetaData(bind=engine)

store_table = Table('stores', metadata, autoload=True)

with engine.connect() as conn:

conn.execute(store_table.insert(), data)

batch_write_to_db(cleaned_data)以上代码展示了从吉客云获取销售数据、进行清洗和转换,并最终批量写入目标数据库的全过程。

通过这种方式,我们可以高效地实现不同系统间的数据集成,确保数据的一致性和完整性。

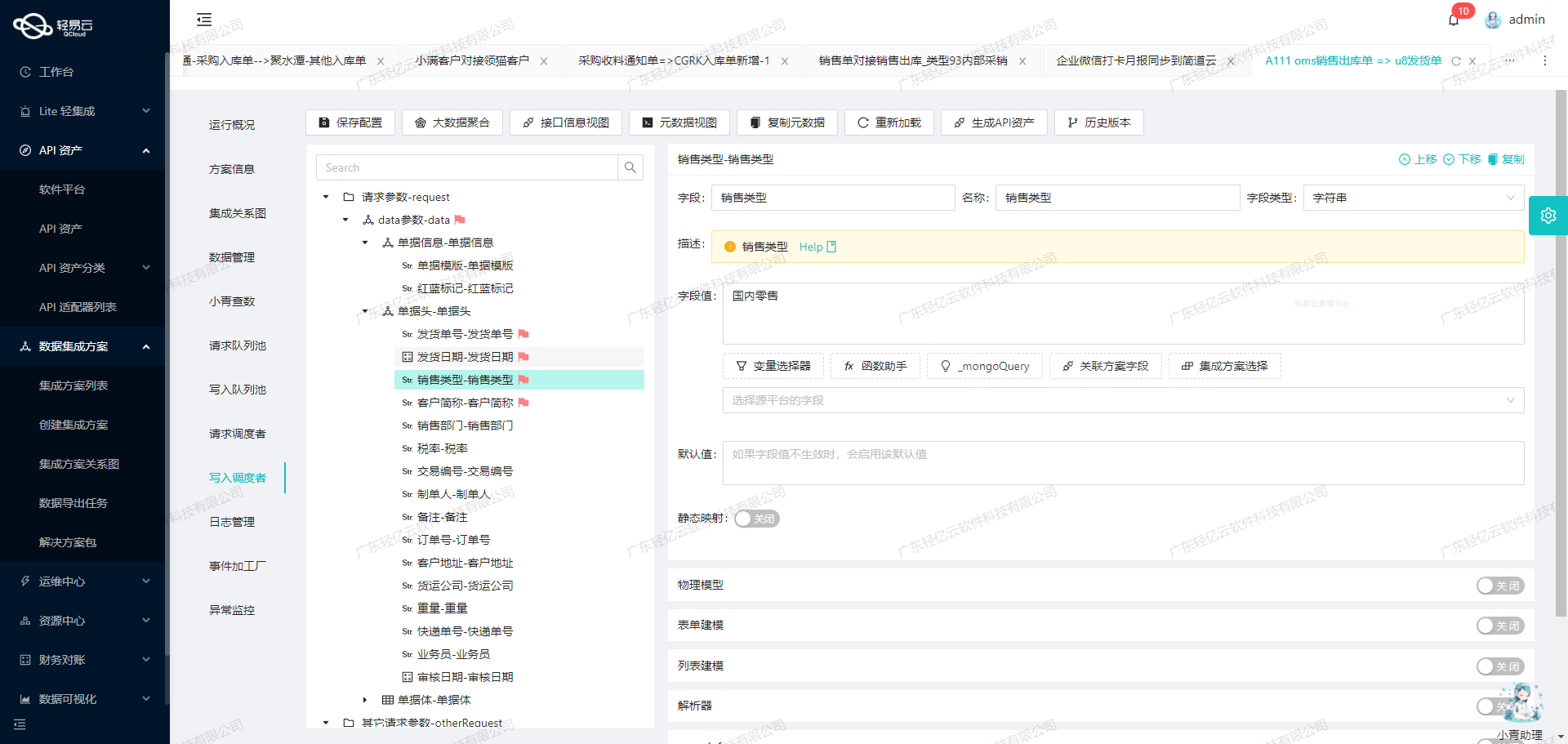

轻易云数据集成平台ETL转换与写入技术案例

在轻易云数据集成平台的生命周期中,第二步是将已经集成的源平台数据进行ETL转换,并最终写入目标平台。本文将详细探讨如何通过配置元数据,将店铺查询的数据转换为轻易云集成平台API接口所能够接收的格式,并最终写入目标平台。

数据请求与清洗

在数据集成过程中,首先需要从源系统获取原始数据,并对其进行清洗。假设我们已经完成了这一阶段,得到了清洗后的店铺查询数据。接下来,我们将重点放在如何将这些数据转换并写入目标平台。

数据转换

为了使源平台的数据能够被目标平台接收,我们需要进行ETL(Extract, Transform, Load)处理。在这个过程中,"Transform"阶段尤为关键。我们需要根据目标平台的API接口要求,对数据进行相应的格式化和转换。

例如,假设我们从源系统获取到如下店铺查询数据:

{

"shop_id": "12345",

"shop_name": "示例店铺",

"location": "北京市",

"owner": "张三"

}根据元数据配置,我们知道目标平台API接口要求如下:

{

"api": "写入空操作",

"method": "POST",

"idCheck": true

}因此,我们需要将上述店铺查询数据转换为符合API接口要求的格式。假设目标API接口期望的数据格式如下:

{

"id": "12345",

"name": "示例店铺",

"address": "北京市",

"contact_person": "张三"

}我们可以使用Python脚本来实现这一转换过程:

def transform_data(source_data):

transformed_data = {

"id": source_data["shop_id"],

"name": source_data["shop_name"],

"address": source_data["location"],

"contact_person": source_data["owner"]

}

return transformed_data

source_data = {

"shop_id": "12345",

"shop_name": "示例店铺",

"location": "北京市",

"owner": "张三"

}

transformed_data = transform_data(source_data)

print(transformed_data)运行上述脚本后,我们得到如下转换后的数据:

{

"id": "12345",

"name": "示例店铺",

"address": "北京市",

"contact_person": "张三"

}数据写入

在完成数据转换后,下一步是将其写入目标平台。根据元数据配置,我们需要使用POST方法调用目标API接口,并且需要进行ID检查(idCheck: true)。

以下是一个使用Python实现HTTP POST请求的示例代码:

import requests

def write_to_target_platform(data):

url = "<目标API接口URL>"

headers = {

'Content-Type': 'application/json'

}

response = requests.post(url, json=data, headers=headers)

if response.status_code == 200:

print("Data written successfully.")

else:

print(f"Failed to write data. Status code: {response.status_code}")

transformed_data = {

"id": "12345",

"name": "示例店铺",

"address": "北京市",

"contact_person": "张三"

}

write_to_target_platform(transformed_data)在上述代码中,我们定义了一个函数write_to_target_platform,该函数接受转换后的数据作为参数,并通过HTTP POST请求将其发送到目标API接口。如果请求成功(状态码200),则表示数据写入成功;否则,会输出失败信息及状态码。

小结

通过以上步骤,我们完成了从源系统获取店铺查询数据、对其进行ETL转换、并最终通过API接口写入目标平台的全过程。在实际应用中,可以根据具体需求和元数据配置,对各个环节进行细化和优化,以确保高效、准确地实现系统间的数据集成。