测试-查询销售渠道信息(已删除数据)-dange:吉客云数据集成到MySQL的技术案例分享

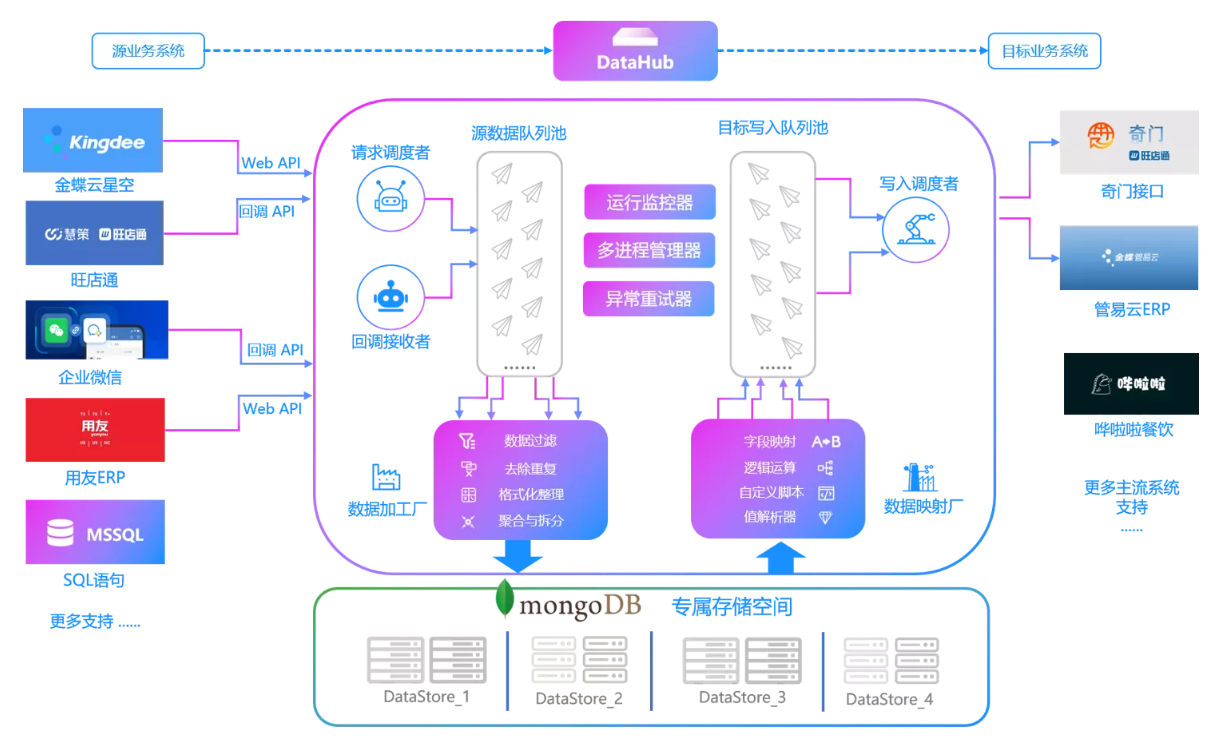

在现代企业的数据管理中,如何高效、可靠地实现多平台间的数据集成是一个关键问题。本次我们将聚焦于一个具体的系统对接案例,即将吉客云中的销售渠道信息(包括已删除数据)集成到MySQL数据库中。该方案名为“测试-查询销售渠道信息(已删除数据)-dange”,通过这一案例,我们将展示如何利用轻易云数据集成平台的强大功能,实现复杂的数据处理和对接任务。

首先,吉客云提供了丰富的API接口,其中erp.sales.get用于获取销售渠道相关的数据。为了确保这些数据能够准确无误地写入到MySQL数据库,我们使用了MySQL的execute API进行数据写入操作。在整个过程中,轻易云平台提供了一系列关键特性,使得这一复杂任务变得更加可控和高效。

-

高吞吐量的数据写入能力:在处理大量销售渠道信息时,高吞吐量的数据写入能力至关重要。这不仅保证了数据能够快速被集成到目标系统中,还提升了整体处理效率。

-

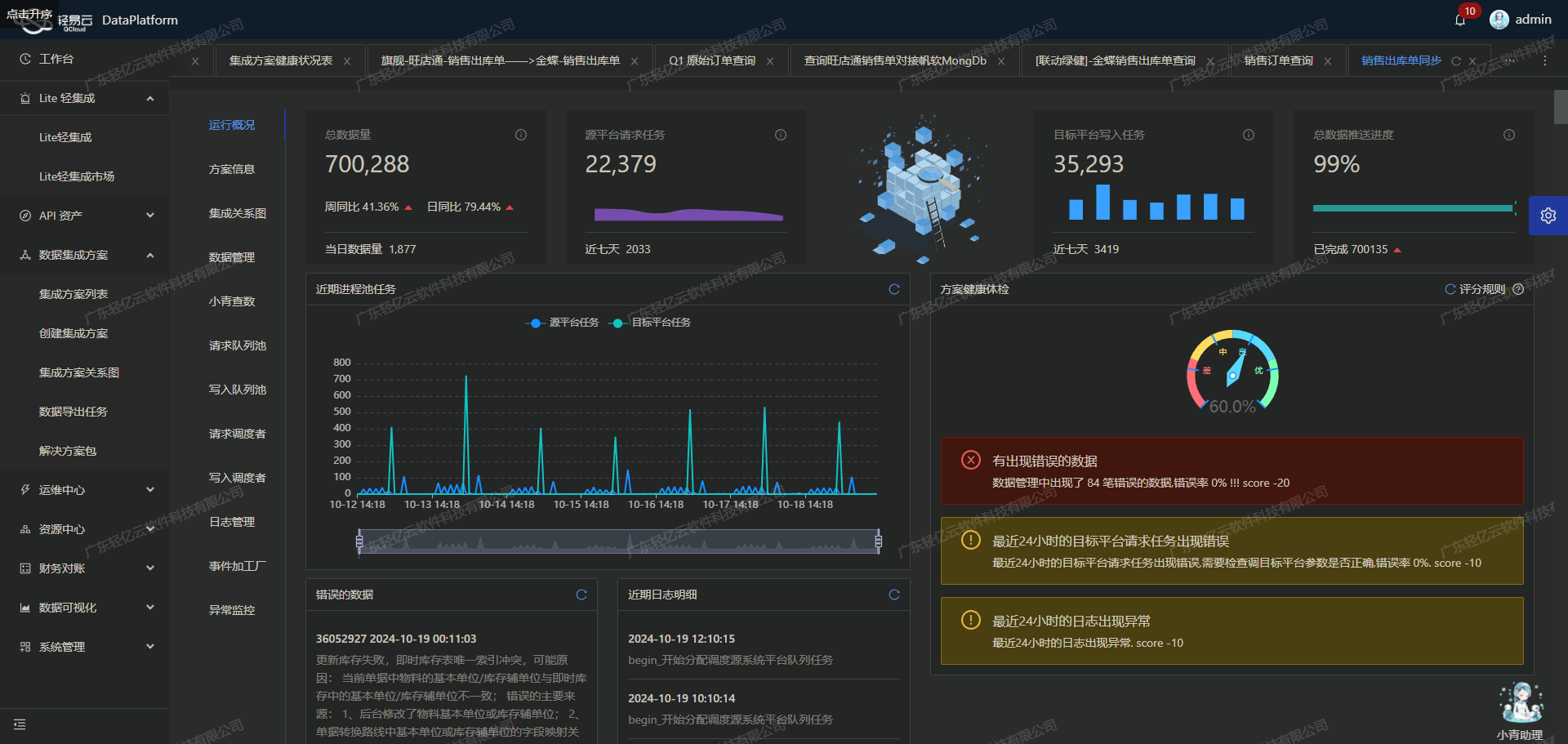

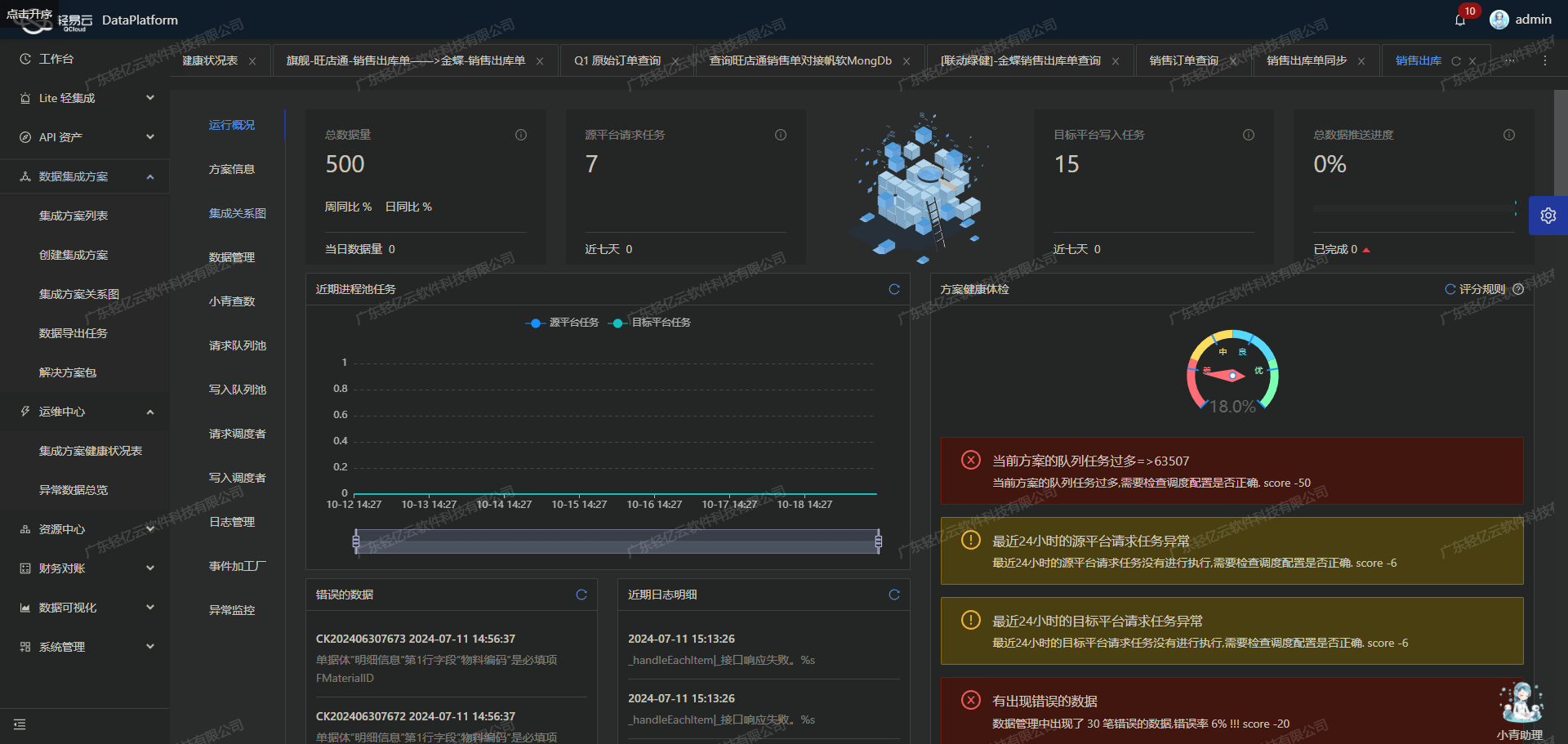

实时监控与告警系统:通过集中化的监控和告警系统,我们可以实时跟踪每个数据集成任务的状态和性能。一旦出现异常情况,系统会立即发出告警通知,从而及时采取措施进行修复。

-

自定义数据转换逻辑:由于吉客云与MySQL之间存在一定的数据格式差异,通过自定义的数据转换逻辑,可以灵活适应不同业务需求和数据结构,确保每条记录都能正确映射到目标数据库中。

-

分页与限流处理:在调用吉客云接口时,为了避免因大量请求导致的性能瓶颈,我们采用了分页与限流策略。这不仅提高了接口调用的稳定性,也确保了每次请求都能顺利完成。

-

异常处理与错误重试机制:在实际运行过程中,不可避免地会遇到各种异常情况。通过完善的异常处理与错误重试机制,可以有效减少因网络波动或其他原因导致的数据丢失问题,确保集成过程中的每一条记录都不漏单。

-

定制化数据映射对接:为了满足特定业务需求,我们还进行了定制化的数据映射对接,使得从吉客云获取的数据能够无缝衔接到MySQL数据库中,并且保持一致性和完整性。

通过上述技术手段,本次“测试-查询销售渠道信息(已删除数据)-dange”方案成功实现了吉客云与MySQL之间高效、可靠的数据集成。在后续章节中,我们将详细介绍具体实施步骤及技术细节,以便更好地理解和应用这些方法。

调用吉客云接口erp.sales.get获取并加工数据

在轻易云数据集成平台的生命周期中,调用源系统接口是关键的第一步。本文将详细探讨如何通过调用吉客云接口erp.sales.get来获取销售渠道信息,并对数据进行初步处理。

接口配置与请求参数

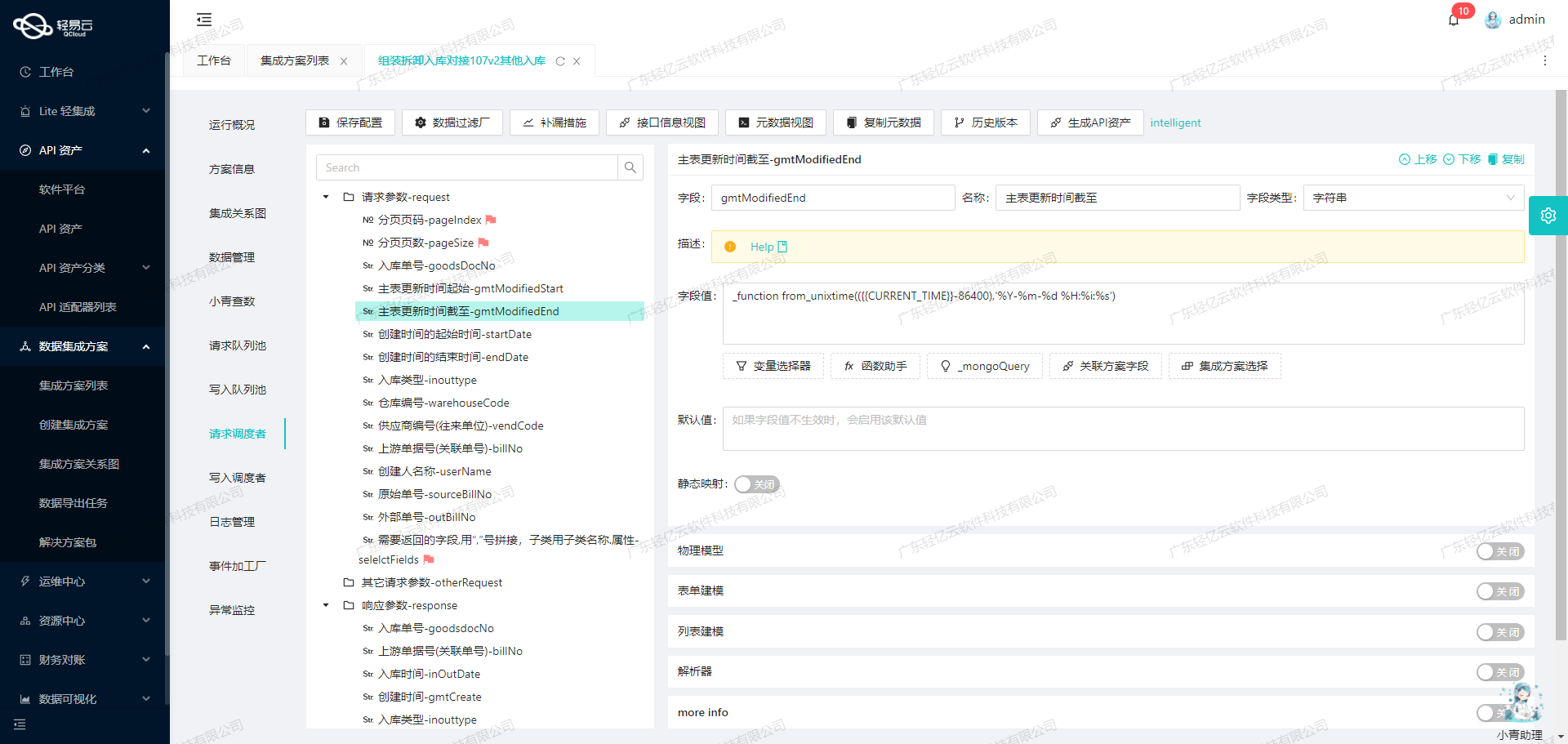

首先,我们需要了解erp.sales.get接口的元数据配置。该接口采用POST方法进行数据查询,主要参数如下:

pageIndex: 页码(默认0)pageSize: 每页记录数(默认50)code: 编号name: 名称gmtModifiedStart: 起始修改时间gmtModifiedEnd: 结束修改时间isBlockup: 是否停用(1表示是,0表示否)isDelete: 是否删除(1表示是,0表示否)

这些参数允许我们灵活地控制查询范围和条件。例如,通过设置isDelete为1,可以查询已删除的数据。

数据请求与分页处理

为了确保不漏单,我们需要处理分页问题。假设每次请求返回50条记录,当总记录数超过50时,需要多次请求才能获取全部数据。这就要求我们在每次请求时动态调整pageIndex参数,并根据返回结果判断是否继续请求下一页。

{

"pageIndex": 0,

"pageSize": 50,

"gmtModifiedStart": "{{LAST_SYNC_TIME|datetime}}",

"gmtModifiedEnd": "{{CURRENT_TIME|datetime}}",

"isBlockup": 1,

"isDelete": 1

}上述示例展示了第一页的请求参数配置。在实际操作中,我们会循环递增pageIndex,直到所有数据被成功获取。

数据清洗与转换

从吉客云获取的数据可能包含冗余或格式不一致的问题,因此需要进行清洗和转换。常见的数据清洗步骤包括:

- 字段映射:将吉客云返回的数据字段映射到目标系统所需的字段。

- 格式转换:例如,将日期字符串转换为标准日期格式。

- 过滤无效数据:剔除重复或不符合业务规则的数据。

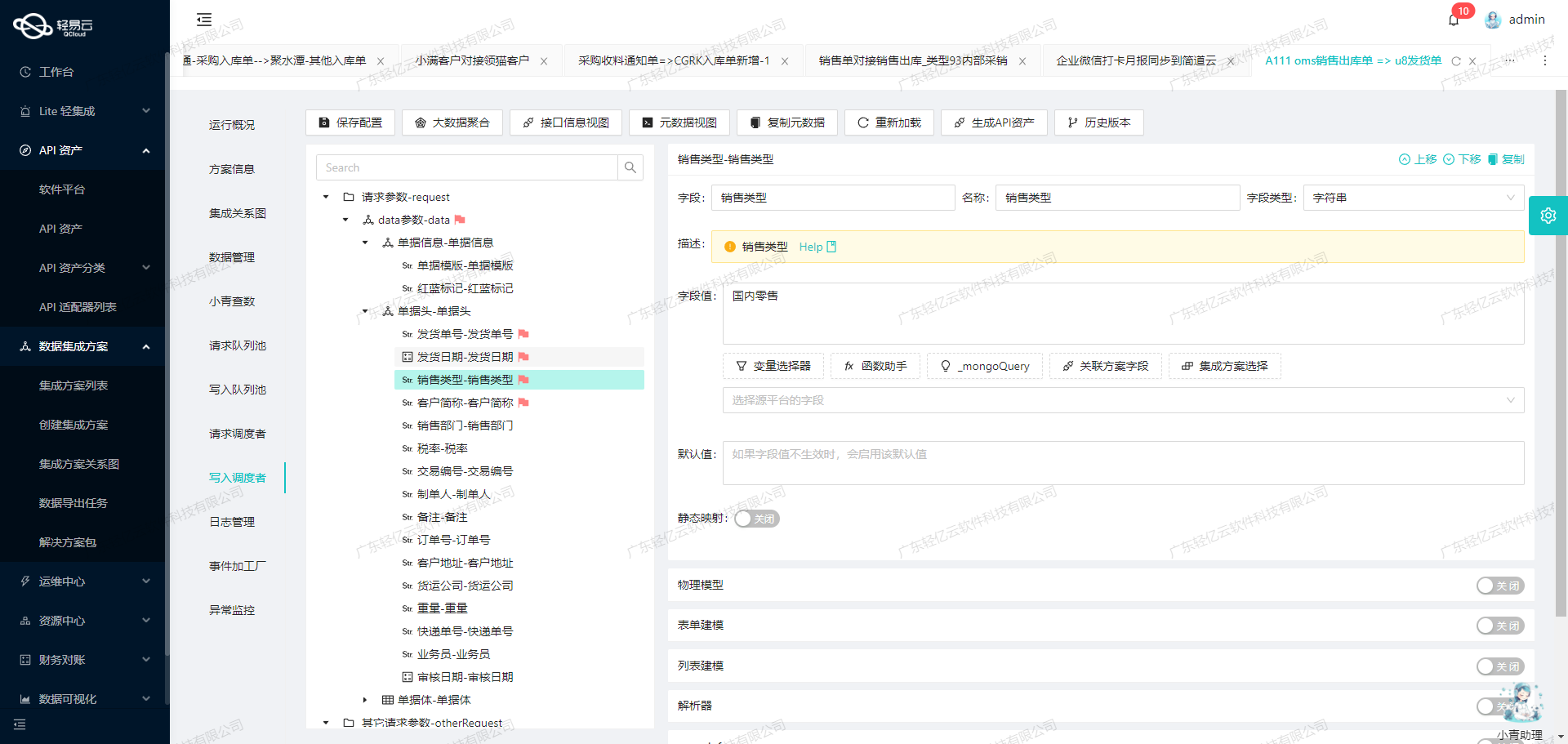

轻易云平台支持自定义数据转换逻辑,使得这些操作可以通过可视化工具直观地完成。例如,可以使用拖拽式界面定义字段映射关系和转换规则,大大简化了复杂的数据处理过程。

异常处理与重试机制

在调用外部API时,不可避免地会遇到网络波动、限流等问题。因此,需要设计健壮的异常处理和重试机制,以确保数据抓取过程的可靠性。具体措施包括:

- 错误捕获:对每次API调用进行错误捕获,并记录详细日志以便后续分析。

- 重试策略:对于临时性错误,如网络超时,可以设置一定次数的重试机制。

- 告警通知:当出现无法自动恢复的错误时,通过告警系统及时通知运维人员介入处理。

实时监控与日志记录

为了全面掌握数据集成任务的状态和性能,轻易云平台提供了集中监控和日志记录功能。通过实时监控,可以随时查看当前任务进度、成功率以及潜在问题。同时,详细的日志记录有助于快速定位并解决问题,提高整体效率。

综上所述,通过合理配置和调用吉客云接口erp.sales.get,结合轻易云平台强大的数据清洗、转换及监控能力,可以高效、安全地实现销售渠道信息的数据集成。这不仅提升了业务透明度,也为后续的数据分析奠定了坚实基础。

数据集成平台生命周期的第二步:ETL转换与数据写入MySQL

在数据集成平台的生命周期中,ETL(Extract, Transform, Load)转换是至关重要的一环。此步骤的核心任务是将已经集成的源平台数据进行转换,以适应目标平台MySQLAPI接口所能够接收的格式,最终将其写入目标平台。这一过程不仅需要处理数据格式差异,还需确保数据的完整性和一致性。

数据提取与清洗

首先,从源平台提取销售渠道信息。为了确保数据质量,我们需要对提取的数据进行清洗和验证。例如,对于字段channel_type,我们需要确保其值在预定义的范围内(0到7之间),以避免数据异常。

{

"field": "channel_type",

"label": "渠道类型",

"type": "string",

"describe": "渠道类型(0:分销办公室; 1:直营网店;2:直营门店;3:销售办公室;4:货主虚拟店;5:分销虚拟店;6:加盟门店;7:内部交易渠道)",

"value": "{channelType}"

}数据转换

数据转换是ETL过程中的关键步骤。我们需要将提取的数据映射到目标平台MySQLAPI接口所需的格式。在这个过程中,需要特别注意字段类型和命名的一致性。例如,将channel_code从字符串类型转换为目标数据库中的相应字段类型。

{

"field": "channel_code",

"label": "渠道编码",

"type": "string",

"value": "{channelCode}"

}通过配置元数据,可以实现自动化的数据映射和转换,确保每个字段都能正确地映射到目标数据库中的相应字段。

数据写入

在数据转换完成后,需要将其写入到MySQL数据库。这里使用了REPLACE INTO语句,以确保如果记录已存在则进行更新,否则插入新记录。这种方式可以有效避免重复记录的问题,同时保持数据的一致性。

REPLACE INTO `lehua`.`sc_sale_channel`

(

`id`,

`channel_code`,

`channel_name`,

`channel_type`,

`plat_code`,

`plat_name`,

`depart_name`,

`link_man`,

`link_tel`,

`office_address`,

`company_name`,

`country_name`,

`province_Name`,

`city_name`,

`town_name`,

`street_name`,

`memo`,

`warehouse_code`,

`warehouse_name`,

`charge_type`,

`depart_code`,

`company_code`,

`is_blockup`,

`is_delete`,

`create_by`,

`update_by`

)

VALUES

(

<{id: }>,

<{channel_code: }>,

<{channel_name: }>,

<{channel_type: }>,

<{plat_code: }>,

<{plat_name: }>,

<{depart_name: }>,

<{link_man: }>,

<{link_tel: }>,

<{office_address: }>,

<{company_name: }>,

<{country_name: }>,

<{province_name: }>,

<{city_name: }>,

<{town_name: }>,

<{street_name: }>,

<{memo: }>,

<{warehouse_code: }>,

<{warehouse_name: }>,

<{charge_type: }>,

<{depart_code: }>,

<{company_code: }>,

<{is_blockup: }>,

<{is_delete: }>,

<{create_by: }>,

<{update_by: }>

);异常处理与错误重试机制

在整个ETL过程中,异常处理与错误重试机制至关重要。通过设置合理的重试机制,可以有效减少因网络波动或其他临时性问题导致的数据丢失。同时,实时监控和日志记录功能可以帮助我们及时发现并解决问题,确保数据集成过程顺利进行。

高效的数据写入

为了支持高吞吐量的数据写入能力,我们可以利用批量操作技术,将多条记录一次性写入数据库。这不仅提高了写入效率,还减少了数据库连接次数,从而提升整体性能。

{

"field": "main_sql",

"label": "主语句",

"type": "string",

"describe": "111",

"value": "<批量插入SQL语句>"

}通过以上步骤,可以实现从源平台到目标平台MySQLAPI接口的数据无缝对接,并确保数据的完整性和一致性。